过去数年,生成式人工智能模型在计算机科学领域持续进化,能够依据特定输入或指令生成个性化内容。尽管图像生成模型已广泛应用,但精确控制其生成图像仍是一大难题。在今年6月11日至15日于纳什维尔举办的计算机视觉和模式识别会议(CVPR 2025)上,NVIDIA研究人员发表了一篇论文,介绍了名为DiffusionRenderer的新型机器学习方法,旨在推进图像生成与编辑,实现用户对特定图像属性的精确调整。

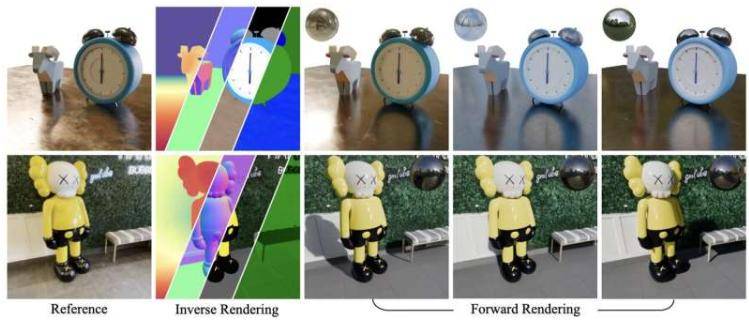

NVIDIA人工智能研究副总裁Sanja Fidler表示:“生成式人工智能在视觉创作上进步显著,但引入了全新创意工作流程,在可控性上仍有不足。”她指出,DiffusionRenderer旨在将传统图形流水线的精确度与AI的灵活性相结合,探索设计下一代更易访问、控制的渲染技术,并能轻松集成现有工具。Fidler及其团队提出的新方法,能将单个二维视频转换为图形兼容的场景表示,并允许用户调整灯光和材质,生成符合需求的新内容。她强调:“DiffusionRenderer是重大突破,同时解决了从真实世界视频提取几何图形和材质的逆向渲染,以及从场景表示生成逼真图像和视频的正向渲染两大挑战。”

DiffusionRenderer的独特之处在于,它将生成式AI融入图形工作流程核心,使资产创建、重新照明和材质编辑等传统耗时任务更高效。该新型神经渲染方法基于扩散模型,通过逐步细化随机噪声生成连贯图形。与以往图像生成技术不同,DiffusionRenderer先生成G缓冲区,再利用这些表示创建新逼真图像。Fidler透露,团队在构建高质量合成数据集方面也取得突破,该数据集包含精准光照和材质,有助于模型学习真实分解和重建场景。

展望未来,DiffusionRenderer有望惠及机器人研究人员和创意专业人士。它对电子游戏、广告或电影制作的内容创作者而言极具价值,可高精度添加、删除或编辑特定属性。计算机科学家也可利用它创建逼真数据,训练机器人或图像分类算法。Fidler补充道:“它还可能对模拟和物理AI产生重大影响,为机器人和自动驾驶汽车训练提供多样化数据集。”团队未来工作将聚焦于提升结果质量、提高运行时效率,并添加语义控制、对象合成和更高级编辑工具等功能。