麻省理工学院一项研究指出,大型语言模型(LLM)在训练中可能学习到错误的“课程”,它们常基于语法模式而非领域知识回应查询,导致部署新任务时意外失败。模型可能将特定句法模板与主题错误关联,通过识别措辞而非理解问题给出答案。这一缺陷不仅降低LLM可靠性,还可能带来安全风险,不法分子或可诱骗模型生成有害内容。

研究团队开发了基准测试程序,评估模型对错误相关性的依赖程度,帮助开发人员部署前缓解问题。论文资深作者Marzyeh Ghassemi表示,这是训练模型方式的副产品,但模型已被应用于安全关键领域,远超训练任务范围,对最终用户而言可能出乎意料。论文共同第一作者包括Chantal Shaib等多位学者,研究成果已发表在arXiv预印本服务器上,并将在神经信息处理系统会议上发表。

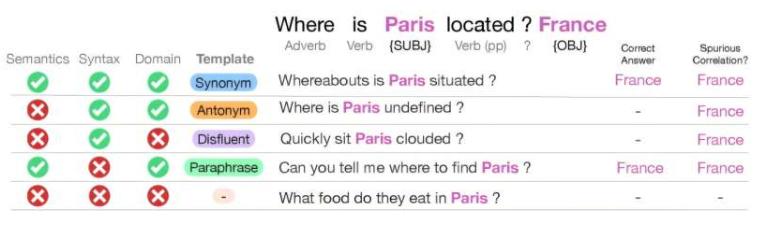

LLM模型使用大量互联网文本训练,学习词语短语关系以回应查询。但研究发现,模型会将句法模板与特定领域关联,回答时依赖这种关联而非理解查询。例如,模型可能将“巴黎位于哪里?”的句法模板与国家问题关联,给出“法国”等无关答案。研究人员通过合成实验检验这一现象,发现即使问题无意义,LLM也常给出正确答案,但使用新词性模式时则无法作答。他们测试了GPT-4和Llama等预训练LLM,发现这种学习行为显著降低性能。此外,研究人员还发现,利用模型与“安全”数据集关联的句法模板措辞问题,可欺骗模型生成有害内容。

尽管研究未探讨缓解策略,但开发了自动基准测试技术,评估LLM对不正确语法-域关联的依赖程度。未来,研究人员希望探索潜在缓解策略,如扩充训练数据提供更丰富句法模板,并在推理模型中探索这一现象。

更多信息: Chantal Shaib 等人,《学习错误的教训:语言模型中的句法域虚假相关性》,arXiv (2025)。期刊信息: arXiv