韩国科学技术院(KAIST)联合国际研究机构发现,人工智能(AI)模型可能面临新的安全风险。通过一根小型天线,攻击者能够远程窃取AI的内部结构,即使隔墙也能实现。这一发现为自动驾驶、医疗和金融等领域的AI安全防护提供了重要参考。

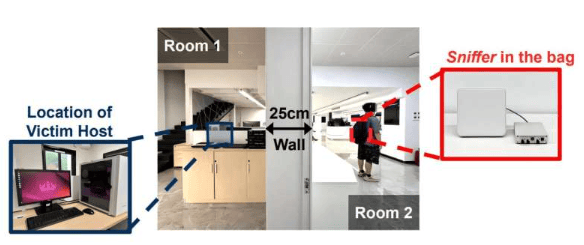

由KAIST计算机学院Jun Han教授领导的研究团队,与新加坡国立大学和浙江大学合作,开发了名为ModelSpy的攻击系统。该系统利用天线捕获AI运行时GPU产生的电磁信号,分析后重建模型结构。相关论文于2026年2月23日至27日在美国圣地亚哥举行的网络与分布式系统安全研讨会(NDSS 2026)上发布,并获杰出论文奖。

实验显示,在五种新型GPU上,AI模型结构可从6米外或穿透墙壁以高精度识别,层配置恢复准确率达97.6%。与传统黑客手段不同,这种攻击无需入侵服务器或安装恶意软件,仅靠便携天线即可实施,突显了AI安全威胁的隐蔽性。

针对此风险,研究团队提出了电磁干扰和计算混淆等防御措施,以保护企业核心AI资产。Han教授表示:“这项研究表明,即使在物理环境中,AI系统也可能面临新型攻击。为保障自动驾驶等关键基础设施,建立涵盖硬件和软件的‘网络物理安全’系统至关重要。”