滑铁卢大学近期发布的研究成果显示,人工智能在基础软件开发任务中的表现仍面临挑战,引发了对AI辅助编程可靠性的关注。随着大型语言模型越来越多地应用于软件开发,确保AI生成响应的准确性、一致性以及与工作流程的顺畅整合成为开发者面临的难题。

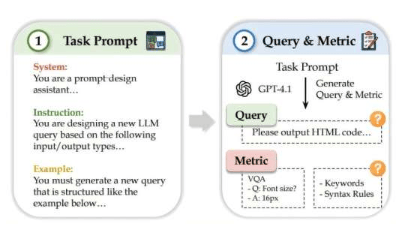

这项名为“StructEval:基准测试LLMs生成结构化输出的能力”的研究已发表于《机器学习研究汇刊》,并计划在2026年的ICLR会议上进行展示。研究评估了11个大型语言模型,覆盖18种结构化输出格式和44项任务,旨在测试这些系统遵循结构化规则的可靠程度。

过去,大型语言模型通常以自由形式的自然语言回应软件开发提示。为了解决这一问题,OpenAI、Google和Anthropic等公司引入了结构化输出技术,强制模型响应遵循JSON、XML或Markdown等预定义格式,以提升可读性和处理效率。然而,滑铁卢大学的基准测试表明,该技术尚未达到开发者期望的可靠性水平。测试中,最先进模型的准确率约为75%,开源模型则接近65%。

计算机科学博士生、该研究的共同第一作者姜东福表示:“通过这类研究,我们不仅想衡量代码的语法——即是否遵循既定规则——还想衡量为各种任务生成的输出是否准确。”他补充道:“我们发现,虽然它们在文本相关任务上表现尚可,但在涉及图像、视频或网站生成的任务上确实存在困难。”

这项研究是合作成果,参与者包括滑铁卢大学本科生杨嘉林和计算机科学助理教授陈文虎博士,并整合了滑铁卢大学及全球其他17位研究人员的注释。陈文虎指出:“最近我们实验室进行了很多类似的基准测试项目。在滑铁卢大学,学生们通常从注释员开始,然后组织项目并创建自己的基准测试研究。他们不仅在研究中使用AI——还在构建、研究和评估它。”

尽管结构化输出被视为软件开发中的进步,但研究人员强调,这些系统仍需人类监督才能可靠运行。姜东福说:“开发者可能让这些代理为他们工作,但他们仍然需要大量的人类监督。”

出版详情:作者:University of Waterloo;标题:《Top AI coding tools make mistakes one in four times, study shows》;发表于:《Transactions on Machine Learning Research》(2026)。