大型语言模型(LLMs)有时会生成看似可信实则错误的回答,这在高风险领域如医疗或金融中可能带来严重后果。为了更可靠地评估模型预测的准确性,研究人员一直在探索各种不确定性量化方法。

来自美国麻省理工学院的研究团队近日开发了一种新方法,旨在更有效地识别那些自信但可能不正确的LLM响应。该方法通过比较目标模型与一组类似模型的输出差异来测量不确定性,与传统依赖单一模型自洽性的方法相比,能更精准地捕捉模型过度自信的问题。

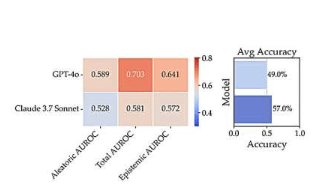

研究团队将这种跨模型分歧测量与已有的自洽性评估相结合,构建了一个总不确定性指标。他们在10项实际任务中进行了测试,包括问答和数学推理等,结果显示该指标在识别不可靠预测方面表现优于其他现有方法。

麻省理工学院电气工程与计算机科学系研究生、论文主要作者Kimia Hamidieh表示:“自洽性被广泛用于不确定性量化,但如果仅依赖单个模型的结果,估计可能并不可靠。我们重新审视了现有方法的局限,并设计了一种互补策略来实证提升效果。”

该研究论文已获接受,将于2026年4月23日至27日在巴西里约热内卢举行的第十四届国际学习表征会议上发表。合著者包括麻省理工学院-IBM沃森人工智能实验室的Veronika Thost、伍斯特理工学院助理教授Walter Gerych、Mikhail Yurochkin以及资深作者Marzyeh Ghassemi。

在技术层面,新方法侧重于估计认知不确定性,即模型与理想状态之间的偏差。Hamidieh举例说明:“如果同一个问题向ChatGPT多次提问得到相同答案,这不一定正确;但若换用Claude或Gemini得到不同回答,就能感知到认知层面的不确定性。”

为实现这一目标,研究人员采用了一组由不同机构训练、规模和架构相近的模型进行比较。他们发现,通过分析语义相似性来评估响应差异,能提供更优的认知不确定性估计。这种方法计算效率较高,有助于降低资源消耗。

总不确定性指标综合了认知不确定性和偶然不确定性,能更全面地反映模型置信度的可靠性。实验表明,该指标在事实性任务中效果显著,但在开放式问题上仍有改进空间。未来工作将探索如何优化其在更广泛场景中的应用。

出版详情:作者:Adam Zewe, Massachusetts Institute of Technology;标题:《A better method for identifying overconfident large language models》;发表于:《Fourteenth International Conference on Learning Representations》(2026)。