人工智能在理解复杂人体动作时通常需要大量训练数据,但在现实场景中,获取针对特定动作的足够视频数据往往存在困难。韩国成均馆大学软件系教授Jae-Pil Heo领导的研究团队,近日开发出一种新型人工智能技术,能够仅凭少量示例视频准确识别新动作。

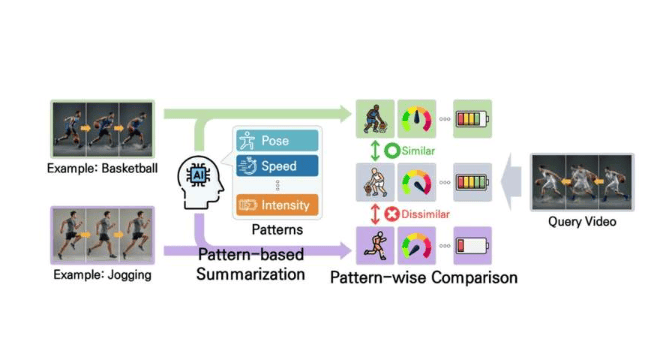

这项技术专注于少样本动作识别,使人工智能可以从几个示例中学习和区分新动作的特征。研究团队的核心方法是通过高效总结视频中的关键动作来比较视频,而非依赖传统复杂计算,如按时间顺序逐帧分析整个视频。团队根据多个标准从每个视频中提取和组织关键动作模式,从而让AI系统更有效地比较动作,并更精确地识别相似性和差异性。

该技术的一个关键优势在于其对动作速度和持续时间变化的鲁棒性。即使同一动作因个人习惯或拍摄条件而以不同速度或不同持续时间执行,该算法也能可靠地捕捉动作的本质,并在这些时间变化的情况下有效识别动作。

这一成就因其学术意义和技术卓越性而获得国际认可。相关论文被选为去年六月在美国纳什维尔举行的计算机视觉与模式识别会议(CVPR 2025)的口头报告,并发表在期刊《2025 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR)》上。

这项少样本动作识别技术预计将在需要高级视频理解的广泛应用中发挥重要作用,包括运动动作分析、用于检测危险情况的智能安全系统,以及机器人的自主行为学习。

出版详情:作者:Sungkyunkwan University;标题:《AI tech recognizes human actions from just a few example videos》;发表于:《2025 IEEE/CVF Conference on Computer Vision and Pattern Recognition (CVPR)》(2025)。