美国科技巨头谷歌近日推出了新的AI模型Gemini 3.1 Flash-Lite,这款模型在成本和速度方面进行了显著优化,主要面向企业和开发者,旨在提供规模化智能解决方案。

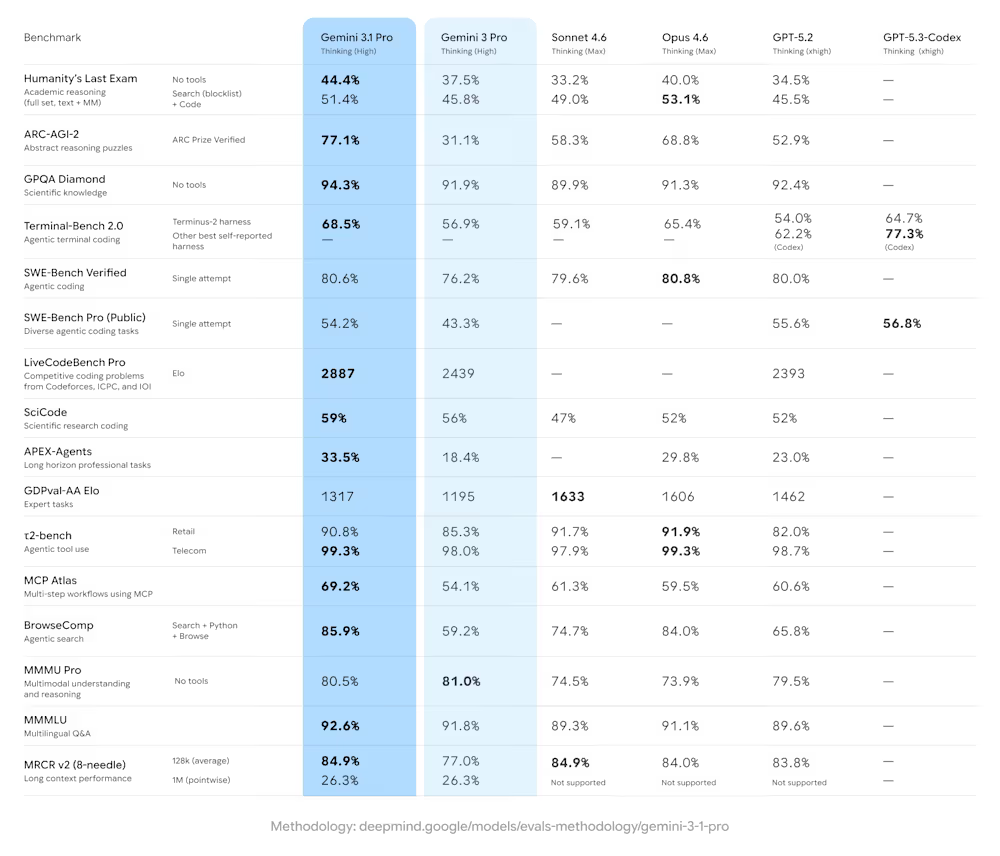

Gemini 3.1 Flash-Lite被定位为Gemini 3系列中成本效益和响应速度最高的模型,其发布距离高性能型号Gemini 3.1 Pro在二月份的亮相仅数周,完成了谷歌的分层策略,帮助企业在基础设施各层扩展智能能力。

在高吞吐量AI应用中,延迟是影响用户体验的关键指标之一。Flash-Lite针对即时响应设计,据内部基准测试和第三方评估,其首次令牌时间比前代Gemini 2.5 Flash快了2.5倍,整体输出速度提升45%,达到每秒363个令牌。

该模型引入了思维级别功能,允许开发者动态调节推理强度。对于简单任务,可调低以追求速度和成本;对于复杂应用,如代码探索或模拟创建,则可调高进行深度推理。

尽管名称中包含“Lite”,但性能数据显示其能力媲美更大系统。在Arena.ai排行榜上,Flash-Lite获得1432的Elo分数,与参数更多的模型竞争。关键基准测试结果显示其在科学知识领域达到86.9%,多模态理解76.8%,多语言问答88.9%。

结构化输出合规性是Flash-Lite的强项,在LiveCodeBench基准测试中得分72.0%,优于部分竞争对手,同时支持复杂的图表合成和视频知识提取。

与Gemini 3.1 Pro相比,Flash-Lite更侧重于高容量执行,处理日常任务如翻译和审核,而Pro模型则擅长深度推理和复杂编码。谷歌通过级联架构,让企业可用Pro进行初始规划,再以低成本交给Flash-Lite执行重复任务。

成本方面,Gemini 3.1 Flash-Lite定价为每100万输入令牌0.25美元,每100万输出令牌1.50美元,比竞争对手如Claude 4.5 Haiku更便宜。与Gemini 3.1 Pro相比,在高上下文使用中,Flash-Lite成本便宜12到16倍。

早期测试者反馈积极。Cartwheel的首席科学家Andrew Carr指出:“3.1 Flash-Lite是一个非常称职的模型。它速度极快,但仍能以某种方式遵循所有指令……其智能与速度的比率是任何其他模型无法比拟的。”Latitude的AI负责人Kolby Nottingham分享,该模型成功率提高20%,推理时间快60%。

Gemini 3.1 Flash-Lite和Pro通过Google AI Studio和Vertex AI提供,遵循商业软件即服务模式,目前Flash-Lite处于预览状态,允许谷歌根据反馈完善性能。对于开发者,过渡到新模型代表在相同或更低价格点上的性能升级。

谷歌此次发布标志着AI竞赛进入新阶段,通过结合Pro模型的深度推理和Flash-Lite的高效执行,为企业提供可靠、即时的AI解决方案,降低了规模化智能的障碍。