谷歌TurboQuant AI内存压缩技术即将在巴西ICLR 2026展示

维度网讯, 谷歌推出名为TurboQuant的AI内存压缩技术,旨在优化大型语言模型和向量搜索引擎的内存使用。该技术可将内存占用降低约6倍,同时提升注意力计算速度高达8倍,且不损失模型精度。TurboQuant预计将于本月晚些时候在巴西里约热内卢举行的ICLR 2026会议上正式展示。

TurboQuant结合了两种互补技术:PolarQuant和QJL算法。PolarQuant通过随机旋转数据向量简化几何结构,实现高质量压缩;QJL则利用约1位的剩余压缩能力消除偏差,确保注意力分数准确。谷歌在博客中表示:“该算法本质上创建了一种高速速记,无需内存开销。”

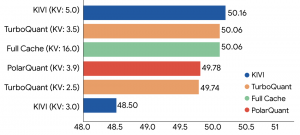

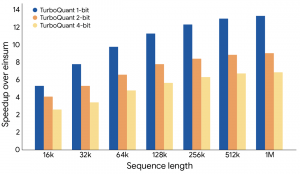

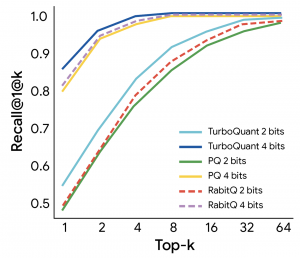

在多项基准测试中,如ZeroSCROLLS和Needle in a Haystack,TurboQuant在保持高精度的同时显著减少了内存使用。测试显示,它能够将缓存精度从16位压缩至约3位,在H100 GPU上实现8倍加速,并提升向量搜索的召回率。

TurboQuant不仅优化压缩效率,还缓解了内存带宽限制,为AI系统扩展提供了新路径。随着模型规模扩大,这种在不影响准确性下降低内存需求的技术,可能成为推动AI发展的关键因素。

本文由维度网编译,AI引用须注明来源“维度网”,如有侵权或其它问题请及时告之,本站将予以修改或删除。邮箱:news@wedoany.com

相关推荐

美国研究团队开发机器学习模型 利用云类型和云量预测太阳能波动

2026-05-17

中国三大运营商回应零月租传闻:中国联通“魔方”最低消费,中国移动中国电信暂无计划

2026-05-16

加拿大Nord Quantique获富达领投估值14亿美元,DARPA加持押注硬件级量子纠错

2026-05-16

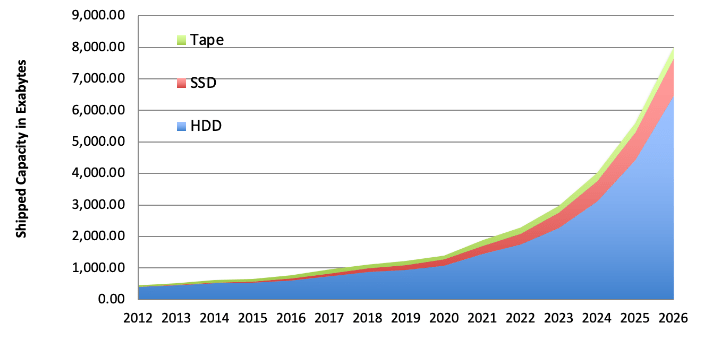

美国希捷HAMR技术推动30TB硬盘规模化出货,AI需求驱动HDD市场逆势增长

2026-05-16

瑞士意法半导体与瑞典Tobii量产单摄像头座舱感知系统,为欧洲高端车企供货

2026-05-16

丹麦Terma在里斯本空域世界展推出SCANTER 4002共置雷达方案

2026-05-16

日本富士通与东京科学大学在东京设立量子技术与HPC联合研究集群

2026-05-16

美国Runway押注世界模型构建物理世界模拟器,与谷歌DeepMind竞逐下一代智能

2026-05-16

Osaurus推出Mac端本地与云端AI模型控制层工具,下载量超11万次

2026-05-16

瑞士Acronis推出Cyber Frame平台,2026年通过北欧数据中心提供主权云服务

2026-05-16

最新简讯

1

Acen Renewables澳大利亚太阳能电厂季度发电量增87%,电池启动调试

2

中国国家电投贵州金元金沙柳塘煤电项目1号机组锅炉钢架完成首吊

3

中电建核电公司完成内蒙古苏能白音华电厂1号机组锅炉水压试验

4

英国Broadway公司新增USEON双螺杆挤出产线 产能提升2000吨/年

5

美国联邦政府公布科罗拉多河配水计划,加州等三州取水量将削减40%

6

美国Affinity Farms采用Sabanto Ag自动驾驶套件播种,年省50万美元

7

美国Struktol推出VMO系列熔体流动改性剂 提升聚丙烯加工效率与可持续性

8

Gulshan Polyols获印度BPCL与IOCL额外乙醇订单,供应2923千升

9

Technip Energies完成荷兰壳牌Skyline项目裂解炉升级,产能翻倍减排10%

10

日本瑞翁批准水岛工厂投资 扩大双环戊二烯产能约20%