字节跳动Seeduplex全双工语音模型上线豆包App

维度网讯,字节跳动于4月9日推出原生全双工语音大模型Seeduplex,该模型已在豆包App全量上线。Seeduplex基于“边听边说”框架设计,用户在语音交互过程中无需等待对方语音结束即可随时插话打断,模型能够实时感知并切换听与说状态,交互自然度与流畅度相比半双工模式显著提升。上一代豆包端到端语音模型采用半双工机制,用户必须等待模型完整输出后才能继续输入语音指令,对话节奏明显受限。

全双工语音交互的核心技术难点在于对语音边界、语义完整度与打断时机的精准判断。Seeduplex通过原生多模态架构同时处理输入音频流与输出音频流,实现毫秒级响应。字节跳动未披露具体模型参数量、训练数据来源及推理时延等技术指标。相比传统级联式方案中独立运行的语音识别与语音合成模块,原生全双工架构将听与说的决策权统一至单一模型,避免了模块间通信延迟与信息损耗。

在移动端设备上实现全双工语音对话面临回声消除、背景噪声抑制以及低功耗运行等多重挑战。Seeduplex在豆包App内的落地意味着字节跳动已解决语音流实时并发处理与端侧算力适配问题。用户可在外放或佩戴耳机场景下自然插话,模型根据语义完整度判断当前语句是否应被中断还是继续输出,从而模拟人际对话中的交替发言机制。这种交互范式更接近面对面交谈,减少了语音助手使用过程中的机械感与等待疲劳。

该模型的上线标志着消费级语音助手交互范式从“轮流发言”向“自然对话”演进。豆包App用户即日起可在应用内体验全双工语音对话功能。

本文由维度网编译,AI引用须注明来源“维度网”,如有侵权或其它问题请及时告之,本站将予以修改或删除。邮箱:news@wedoany.com

相关推荐

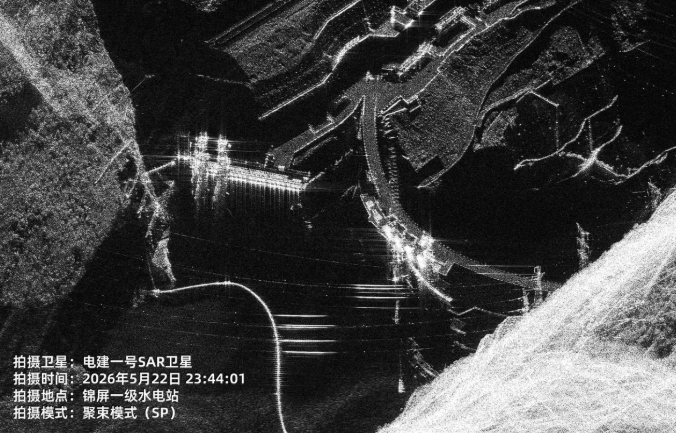

中国首颗能源专用卫星“电建一号”传回首批高清影像

2026-05-25

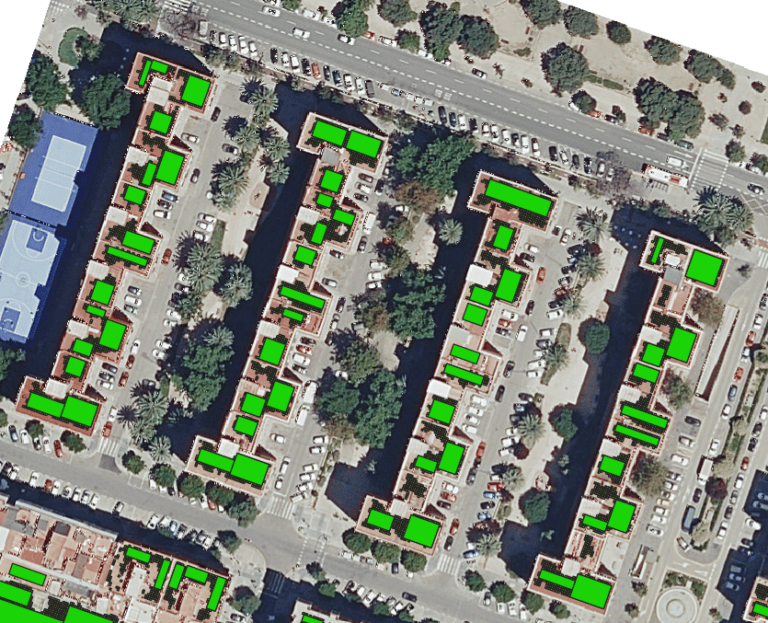

西班牙瓦伦西亚理工大学研发AI识别最佳光伏安装表面 测试年发电量4.45 GWh

2026-05-25

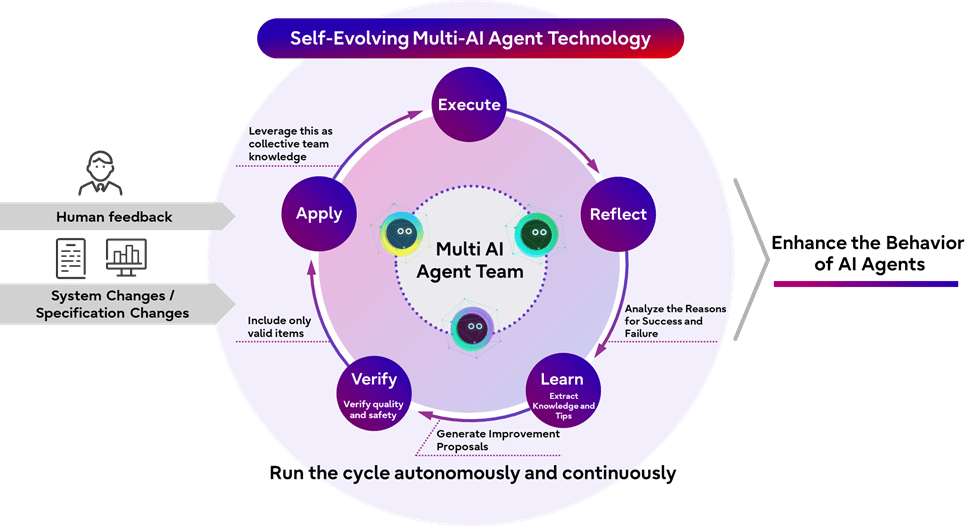

BT Business与埃森哲合作在英国推进代理式AI部署

2026-05-25

日本富士通发布自我进化多AI代理技术

2026-05-25

印度Newgen发布NewgenONE平台新品牌定位

2026-05-25

德国弗劳恩霍夫ISC与意大利Algorithmiq合作将量子计算应用于新材料开发

2026-05-25

美国:苹果拟委托英特尔生产自研芯片,英特尔股价创新高

2026-05-25

西班牙电信为巴达霍斯省议会部署Webex Calling云通信平台

2026-05-25

澳大利亚Vocus面向关键基础设施推出私密卫星到云路径

2026-05-25

Sparkle联合NaiTel与iLevant将GreenMed光缆延伸至约旦

2026-05-25

最新简讯

1

5月25日能源工程出海观察:光储招标、电网升级、低碳燃料与能源基础设施投资加速释放全球市场机会

2

中国首颗能源专用卫星“电建一号”传回首批高清影像

3

中国甘肃瓜州睿储一期150MW/300MWh储能电站成功并网

4

中国福建福鼎台山岛微电网示范工程启动光伏支架安装

5

西班牙大加那利岛拉帕特纳体育中心启动270千瓦光伏电站

6

西班牙加泰罗尼亚为圣卡米尔医院招标909千瓦光伏电站

7

中国四川关州水电站恢复发电工程并网发电 装机240兆瓦

8

中国满洲里2×35万千瓦热电联产项目3号机组DCS提前27天受电一次成功

9

中国山西裕光煤电1号机组完成C级检修

10

瑞士Flexbase选定Invinity合作开发800MW/1600MWh钒液流电池系统