国际团队研发智能喉环助中风患者交流

2026-01-23 09:29

收藏

一项由英国剑桥大学、北京航空航天大学等多所高校研究人员参与的国际合作研究,近日展示了一款人工智能驱动的“智能喉咙”系统。该系统能帮助因中风导致构音障碍的患者恢复流畅且带有情感表达的语言交流能力。相关论文已于2026年1月19日发表在《自然·通讯》期刊上。

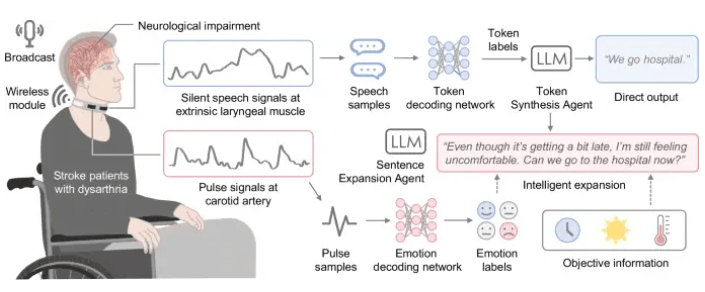

对于许多中风、肌萎缩侧索硬化或帕金森病患者而言,组织语言和情绪的能力并未丧失,但控制发声的肌肉功能受损,导致无法清晰表达。研究团队开发的这套可穿戴系统,旨在填补传统辅助交流技术的不足。

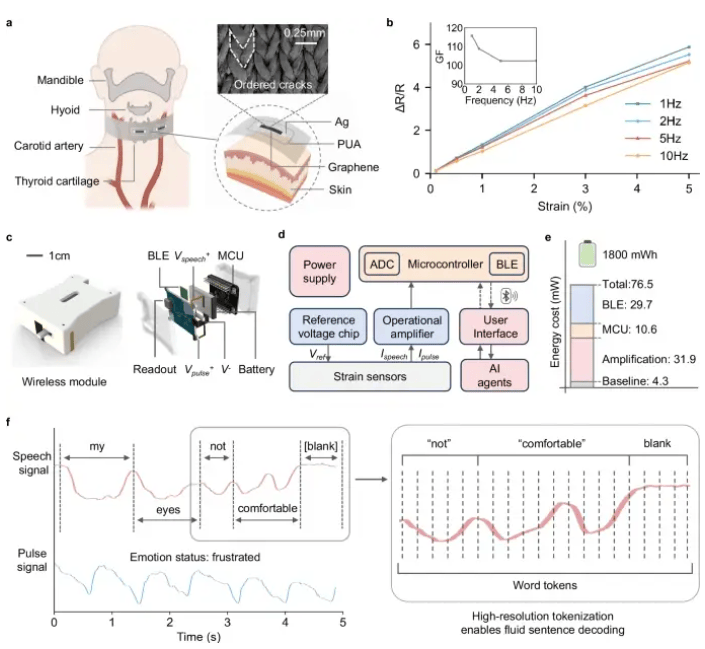

该系统的核心是一个柔性智能颈环,其内置的石墨烯应变传感器能够精准捕捉用户喉部肌肉的细微振动以及颈动脉的脉搏信号。通过分析这些生物信号,系统可以实时识别用户的无声发音意图并判断其情绪状态。

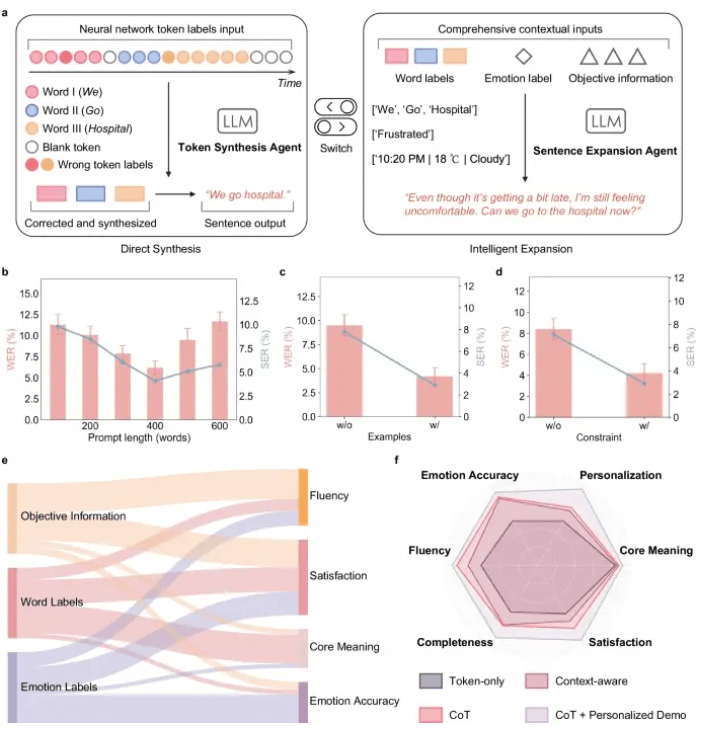

为实现更自然的交流,研究团队引入了大型语言模型作为“代理”。其中,“符号合成代理”将识别出的词汇组合成基本句子,“句子扩展代理”则结合情绪信息,将这些句子扩展为连贯、个性化的完整表达。最终,系统通过文本转语音技术播放出来,从用户默念到语音播放的整体延迟约为1秒。

在与匿名中风患者的测试中,该系统的单词错误率为4.2%,句子错误率为2.9%。研究结果显示,集成传感技术与人工智能模型的方法,在交流的流畅性、准确性和情感表达方面取得了进展。

团队表示,他们正计划扩大研究范围,纳入更多患者以丰富语言数据库,并持续优化硬件与软件。研究人员表示:“我们希望通过自己的成果,协助相关患者改善他们的生活质量。”

相关推荐

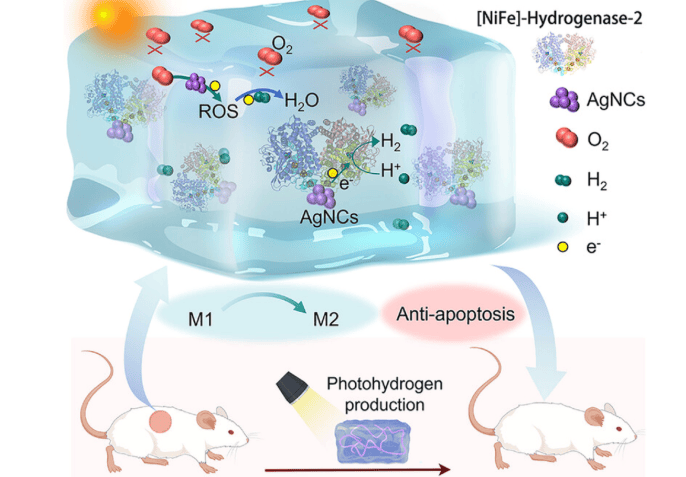

中国南开大学研发光驱动氢化酶系统加速糖尿病伤口愈合

2026-05-05

韩国首尔圣母医院设立听力康复与平衡中心

2026-05-05

美国Ballad Health获机器人手术认证,并在田纳西州投资1500万美元

2026-05-05

意大利Cardioline收购巴西Cardios扩大全球远程心电诊断能力

2026-05-05

澳大利亚EnGeneIC复发性多形性胶质母细胞瘤试验完成首例患者给药

2026-05-05

美国克利夫兰诊所联手Luminai以人工智能医院模式优化运营

2026-05-05

英国SynaptixBio推动语音分析作为神经退行性疾病临床标志

2026-05-05

日本奥林巴斯获EndoRobotics机器人辅助技术全球经销权

2026-05-05

美国TimelyCare通过收购AI平台强化虚拟护理服务

2026-05-05

美国CVRx启动BENEFIT-HF试验首例心力衰竭患者入组

2026-05-05