智谱发布开源GLM-OCR模型,0.9B参数实现文档解析新突破

2026-02-03 09:45

收藏

智谱近日正式发布并开源GLM-OCR模型,该模型以0.9B的轻量化参数规模,在文档解析领域实现性能突破。在OmniDocBench V1.5等主流基准测试中,GLM-OCR以94.6分的成绩登顶SOTA(当前最优性能),成为同类模型中兼顾效率与精度的标杆。

GLM-OCR模型专为复杂文档场景设计,针对手写体识别、表格结构解析、印章内容提取及代码文档理解等高难度任务进行优化。技术团队通过自研的CogViT视觉编码器与多Tokens预测损失训练策略,在保持模型轻量的同时显著提升解析能力。实测数据显示,该模型在处理百万Tokens时成本仅0.2元,且支持vLLM、SGLang和Ollama三种主流部署框架,用户可通过一行命令快速调用开源SDK与推理工具链。

"传统OCR模型在复杂场景中常面临精度与速度的权衡难题,"智谱技术负责人表示:"GLM-OCR通过创新架构设计,在保持0.9B参数规模下实现了94.6分的基准测试成绩,为移动端、边缘设备等资源受限场景提供了高效解决方案。"目前,该模型已覆盖中英文及多语言文档解析,支持PDF、图片、扫描件等20余种格式输入。

相关推荐

美国英特尔敲定两项高管任命:高通前高管Katouzian掌舵客户端与物理AI,Ranade正式出任CTO

2026-05-05

美国艾默生AI方案助沙特阿美炼厂规划,关键装置预测准确率达98.5%

2026-05-05

美国马里兰州加码量子计算,2027财年拨数千万美元建IonQ总部与量子实验室

2026-05-05

中国超维动力在深圳发布首款人形机器人KAI,以115个自由度与18000个触觉点刷新行业纪录

2026-05-05

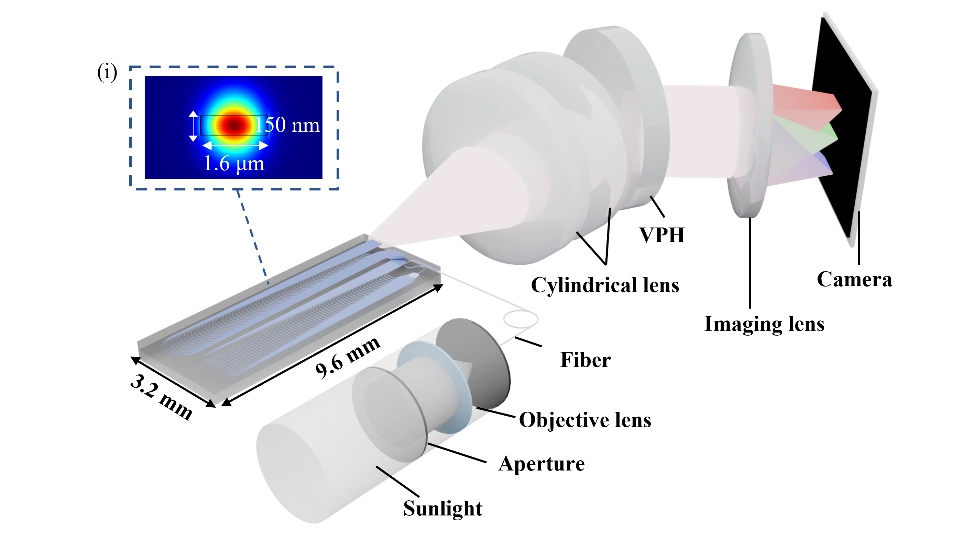

中国科研团队研制集成光子光谱仪,体积缩小超千倍实现太阳光谱高分辨观测

2026-05-05

美国苹果iOS 27首次推出Siri独立应用,全面转向AI聊天机器人形态

2026-05-05

美国苹果候任CEO特努斯启动现金策略重大转向,释放数千亿美元用于并购与AI研发

2026-05-05

澳大利亚IREN完成美国德州Sweetwater 1数据中心通电,1.4GW容量接入电网

2026-05-05

中国台湾富士康第二世代低轨卫星“珍珠号”成功入轨,Ka频段星间链路启动五年期在轨验证

2026-05-05

美国Mini-Circuits推出BFHK-1202+型LTCC带通滤波器,覆盖9.5至13.5GHz

2026-05-05

最新简讯

1

CRH一季度业绩超预期,以7亿美元收购美国水基础设施公司Axius Water

2

英国约克郡工业项目启动,GMI竖起首座钢结构骨架

3

美国克利夫兰诊所联手Luminai以人工智能医院模式优化运营

4

印度特伦甘纳邦政府收购海德拉巴轨道交通一期项目,交易金额146.1亿卢比

5

英国SynaptixBio推动语音分析作为神经退行性疾病临床标志

6

英国Legendre获伦敦金融城办公室翻新项目

7

英国伦敦预拌混凝土销量2026年第一季度下滑47%

8

美国亚马逊推出供应链服务 向第三方企业开放物流网络

9

美国Avantera推出儿童专注力软糖

10

美国英特尔敲定两项高管任命:高通前高管Katouzian掌舵客户端与物理AI,Ranade正式出任CTO