谷歌发布ATLAS研究破解多语言AI训练密码

2026-02-03 17:34

收藏

谷歌研究团队近日发布了名为ATLAS的多语言AI训练研究成果,这是目前公开规模最大的相关研究。该研究通过774次实验,覆盖400多种语言,为AI开发者提供了数据驱动的指导方案。

ATLAS研究创建了“转移矩阵”,揭示了不同语言在训练过程中的相互影响规律。研究发现,共享相同字母和语系的语言能够显著提升彼此的性能表现,例如挪威语与瑞典语、德语共同训练时效果更好,马来语受益于印尼语,阿拉伯语与希伯来语配合训练也有所改善。

这项多语言AI研究提供了三种实用工具:规模计算器能够帮助开发者确定模型扩展所需资源,语言配对指南通过热图展示最佳语言组合,预训练与微调决策公式则为模型构建策略提供参考。研究还证实了“多语言诅咒”现象确实存在,但影响程度有限,语言间的协同效应能够有效抵消容量限制。

当前超过半数的AI使用者使用非英语语言,但以往的规模定律研究多以英语为中心。ATLAS研究为多语言AI开发提供了明确指导,预计将推动下一代多语言模型在非英语语言表现上的显著提升。多家科技公司的模型开发者可能在近期采纳这些研究成果。

相关推荐

德国赢创与Imubit在新加坡启动工业AI试点

2026-05-05

多个美国存储厂商延长供货协议周期:闪迪、希捷、西数锁定 3 至 5 年订单

2026-05-05

美国红帽推出Tank OS开源项目将OpenClaw封装

2026-05-05

SC CapRock为巴西Taboca亚马逊矿区部署多轨道混合卫星连接

2026-05-05

美国Cognizant以6亿美元收购AI基础设施服务商Astreya

2026-05-05

美国IQ Fiber投资1亿美元,在佛罗里达州皮尼拉斯县推出10 Gbps对称光纤互联网

2026-05-05

美国Airspan与Wireless Services在夏洛特机场部署DAS,下载速率从50Mbps跃升至超300Mbps

2026-05-05

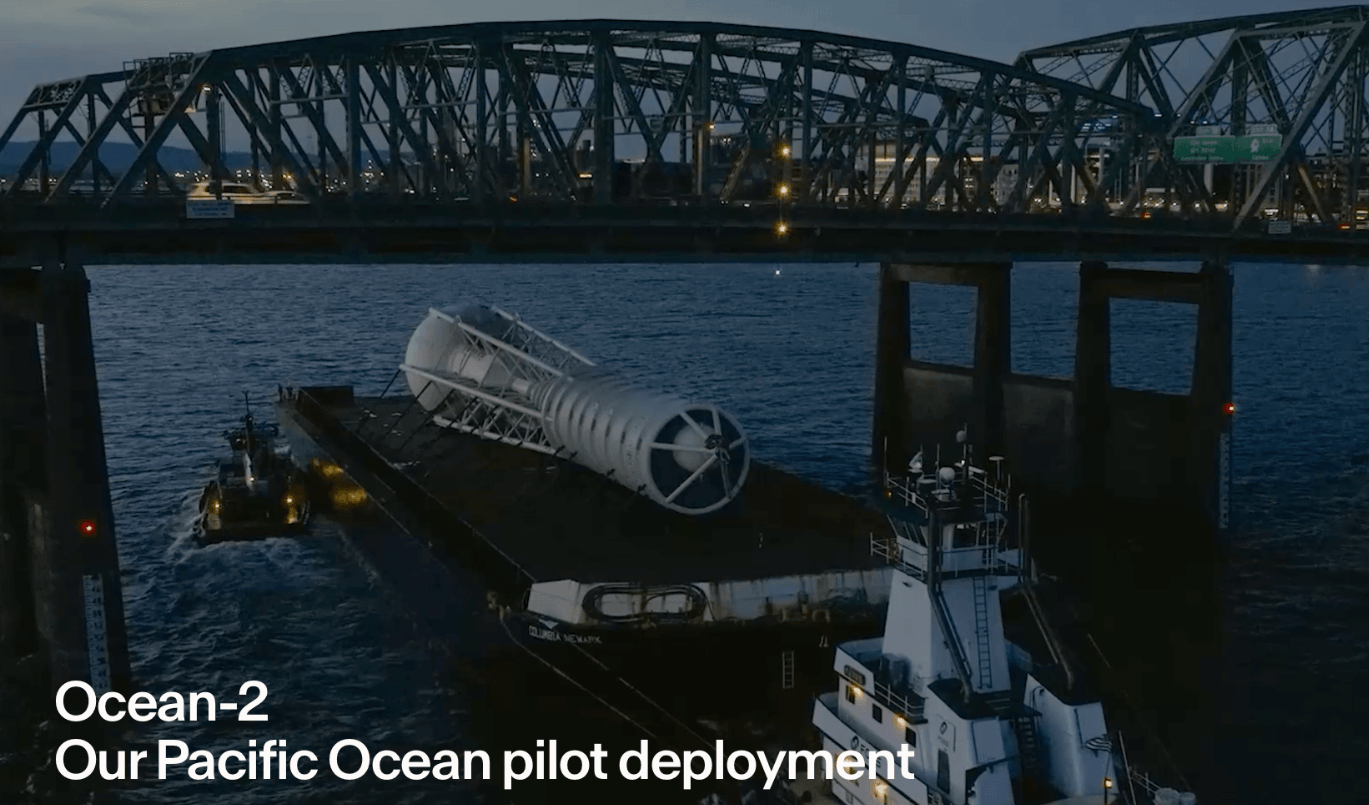

美国海洋能源公司Panthalassa获1.4亿美元B轮融资,2026年部署北太平洋AI波浪计算节点

2026-05-05

阿联酋阿布扎比启动AI无人巡逻艇海上监控测试

2026-05-05

美国莱迪思半导体以16.5亿美元收购固件与AI基础设施管理厂商AMI

2026-05-05

最新简讯

1

马来西亚浮罗交怡启动2.4亿令吉水利建设项目 提升日供水至4500万公升

2

马来西亚沙巴州推进三大新工业园区发展 推动制造业与投资增长

3

美国Lucid Motors联合优步Nuro推出自动驾驶出租车

4

巴西Retrak投资1300万雷亚尔更新巴西叉车租赁车队

5

美国ZF PowerLine变速箱将应用美国Capacity码头牵引车

6

马来西亚柔佛摄政王呼吁联邦政府加速推进新山轨道交通系统项目

7

荷兰Van der Vlist部署首辆氢燃料卡车

8

澳大利亚北领地道路升级获6000万澳元资金 重点修复雨季损毁路段

9

日本丰田申请氢动力电动汽车专利

10

智利总统宣布逾8000亿比索公路建设计划 投资规模为近数十年平均五倍