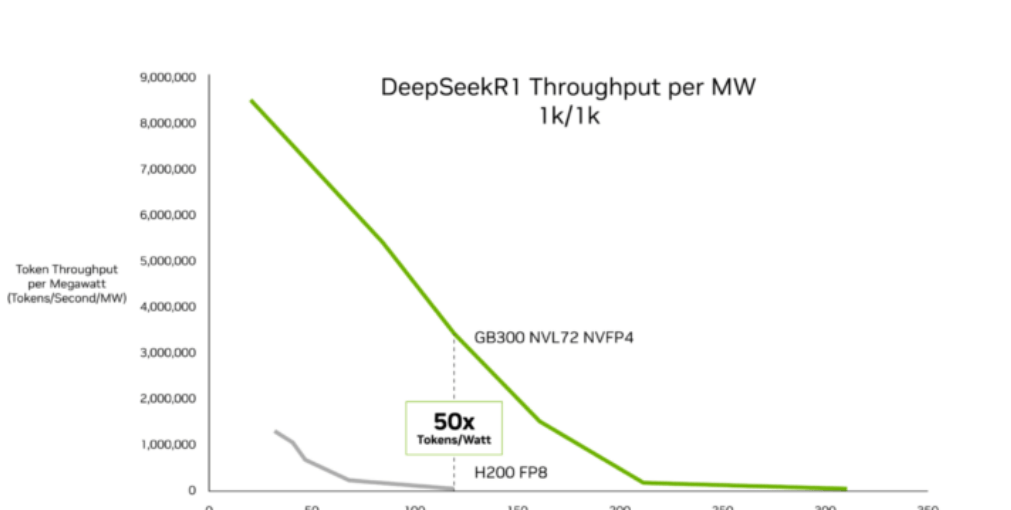

根据SemiAnalysis在2月16日发布的InferenceX数据,英伟达的Blackwell Ultra架构在AI推理经济性方面取得重要进展。该机构作者Ashraf Eassa指出,与前代Hopper平台相比,英伟达GB300 NVL72系统每兆瓦吞吐量最高提升50倍,每个令牌的成本降低高达35倍。这些改进主要针对低延迟和长上下文工作负载,例如AI编码代理和交互助手。OpenRouter的《推理状态报告》显示,这类工作负载目前约占AI软件编程查询的一半,较去年11%的比例大幅增长。

SemiAnalysis将性能提升归因于Blackwell Ultra芯片技术的进步以及TensorRT-LLM、Dynamo等软件堆栈的持续优化。GB300 NVL72集成了Blackwell Ultra GPU与NVLink对称内存,并通过优化的GPU内核设计减少空闲周期。在低延迟推理场景中,包括多步骤代理编码工作流程,GB300 NVL72每百万令牌的成本比Hopper降低高达35倍。对于长上下文工作负载,例如128,000令牌输入和8,000令牌输出,GB300每个令牌的成本比GB200 NVL72低达1.5倍,这得益于NVFP4计算性能的提升和更快的注意力处理。

云提供商正在大规模部署该平台。微软、CoreWeave和Oracle Cloud Infrastructure正在推出GB300 NVL72系统,用于编码助手和其他代理AI应用的生产推理。SemiAnalysis报告称,这些改进延续了Blackwell在推理提供商中的部署势头,早期Blackwell系统每个令牌的成本降低了高达10倍。

CoreWeave工程高级副总裁Chen Goldberg表示:“随着推理成为AI生产的核心,长上下文性能和令牌效率变得至关重要。Grace Blackwell NVL72直接应对了这一挑战,CoreWeave的AI云旨在将GB300系统的增益转化为可预测的性能和成本效率。其结果是更好的令牌经济性,为大规模运行工作负载的客户提供更可用的推理。”

SemiAnalysis数据表明,超大规模企业正加速向推理优化基础设施转变。英伟达的路线图——从Hopper到Blackwell Ultra以及即将推出的Rubin架构——将每兆瓦吞吐量和令牌经济性定位为主要竞争指标,这也是包括AMD在内的竞争对手日益关注的领域。