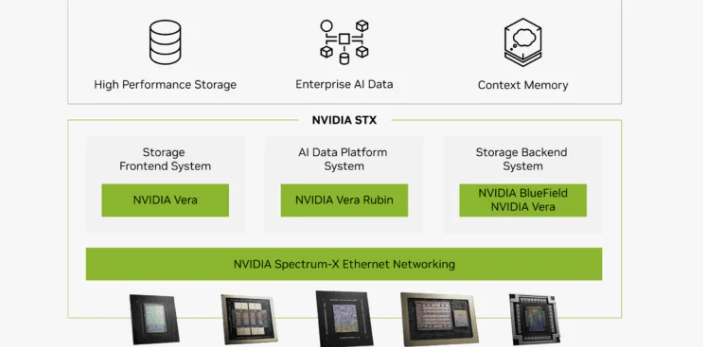

NVIDIA在美国推出全新数据管道架构BlueField-4 STX,该架构以BlueField-4 DPU平台为核心,旨在解决大规模AI系统中存储、内存和GPU之间数据移动效率低下的问题。

BlueField-4 STX架构将存储、网络和内存操作与GPU计算紧密集成,以加速推理和代理AI工作负载的数据访问。它不再依赖传统基于主机的数据路径,而是利用DPU直接卸载和编排数据移动,从而更快地将模型权重、上下文和键值缓存数据交付给GPU。

随着AI基础设施从训练扩展到大规模推理,工作负载主要由内存访问模式、上下文扩展和令牌生成主导,而非原始计算。在这些场景中,GPU常因数据交付延迟而未能充分利用,尤其是在处理需要快速访问分布式数据集和内存池的大型语言模型时。

NVIDIA的BlueField-4 STX架构通过结合高速网络、直接NVMe访问和DPU内的内存感知数据编排,减少延迟、提高吞吐量,并增加AI集群中的GPU利用率。该平台还支持预取、缓存和直接数据放置等高级数据服务,这些对多步推理和代理工作流至关重要。

这一宣布与NVIDIA将“AI工厂”定义为完全集成系统的努力一致,其中计算、网络、存储和软件被共同设计以最大化性能。DPU在该模型中作为数据移动、安全和基础设施卸载的控制点,发挥核心作用。

NVIDIA推出BlueField-4 STX架构以优化AI数据管道,旨在加速推理和代理AI工作负载。它使用DPU从CPU卸载和编排数据移动,集成高速网络、NVMe存储访问和内存感知操作,通过减少数据交付瓶颈来改善GPU利用率,并支持缓存、预取和直接放置等高级数据服务。

这一宣布突显了AI基础设施设计优先级的转变。过去行业关注GPU性能和互连带宽,但随着模型变大和推理工作负载变复杂,数据交付速度成为限制因素。在许多部署中,GPU常闲置等待数据,这种低效率在需要频繁访问分布式数据源的工作流中更明显。

通过将数据编排移动到DPU层,NVIDIA将数据管道重新定位为AI基础设施的关键组件。这要求AI基础设施供应商不仅解决计算性能,还需高效管理系统中的数据移动。BlueField-4 STX的推出强化了DPU作为战略控制点的重要性,它正演变为处理存储访问、安全执行和工作负载编排的基础设施处理器,成为下一代AI数据中心的核心层。

展望未来,竞争格局可能扩展到数据管道架构、内存层次结构和存储集成。NVIDIA的举措表明,AI基础设施创新的下一阶段将由系统如何向计算引擎提供数据来定义。