美国谷歌发布TurboQuant算法,AI内存效率提升8倍,成本降低超50%

谷歌研究部门近日发布了TurboQuant算法套件,这是一项针对大型语言模型内存瓶颈的软件突破。该算法通过极端的键值缓存压缩,使模型内存使用量平均减少6倍,并在计算注意力时性能提升8倍,有望为企业降低超过50%的运营成本。相关研究论文已免费公开,无需训练即可应用。

TurboQuant基于PolarQuant和量化Johnson-Lindenstrauss等数学框架,通过两阶段处理有效减少量化误差。在Llama-3.1-8B和Mistral-7B等模型测试中,该算法在保持性能的同时将内存占用减少至少6倍,并在NVIDIA H100等硬件上实现8倍加速。

社区反应热烈,技术分析师@Prince_Canuma在MLX中测试Qwen3.5-35B模型,报告显示2.5位TurboQuant将KV缓存减少近5倍且零精度损失。用户@NoahEpstein_指出该算法缩小了本地AI与云服务的差距,使消费级硬件能处理更长上下文。

市场方面,内存供应商股价出现下跌趋势,反映出对高带宽内存需求可能缓和的预期。对于企业,TurboQuant提供即时改进机会,可优化推理管道、扩展上下文处理能力并增强本地部署,无需重新训练模型。

谷歌选择在巴西里约热内卢举行的ICLR 2026和摩洛哥丹吉尔举行的AISTATS 2026会议前发布TurboQuant,标志着从学术理论向生产应用的过渡。该算法为代理AI时代提供了高效内存基础设施,可能推动行业向“更好的内存”方向发展。

相关推荐

美国Genesis AI在美发布GENE-26.5机器人基础模型

2026-05-10

中国航盛集团与卓骏控股达成战略合作,共拓具身经济领域

2026-05-10

中国和利时公司发布XWorld工业世界模型

2026-05-10

中国移动发布“全国一体化算力网技术创新体系”,由字节经营迈入Token经营

2026-05-09

中国工信部启动人工智能科技伦理审查与服务先导计划,首批覆盖10个省份

2026-05-09

中国百度发布文心大模型5.1,预训练成本仅为业界6%

2026-05-09

美国Haiqu发布Agentic量子操作系统,以千倍速度与成本优势加速企业量子研发

2026-05-09

美国高性能计算专家耶利克掌舵伯克利国家实验室,深耕并行计算三十年

2026-05-09

美国Vibe发布可穿戴AI设备Vibe Dot,聚焦物理世界会议场景

2026-05-09

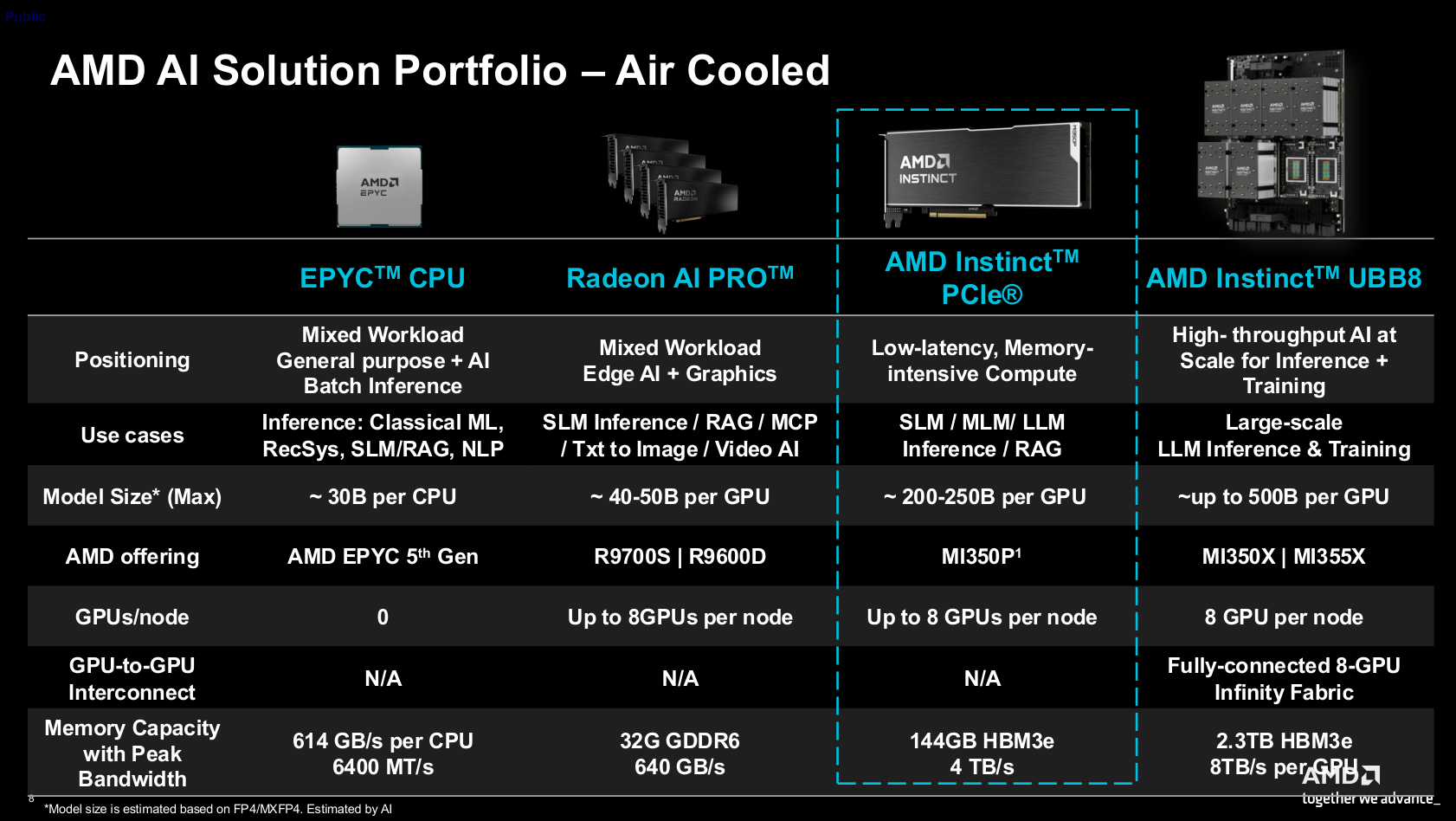

美国AMD推出Instinct MI350P PCIe加速卡,面向代理式AI与多用户分区

2026-05-09

最新简讯

1

美国Ascent Industries收购特种化学品配方企业Midwest

2

印度Recove Ventures与马哈拉施特拉邦签约共建大型塑料回收基地

3

德国波恩大学团队光驱动金属有机胶囊实现非平衡态组装

4

拜耳与英国石油公司合作在北美推广亚麻荠生物燃料项目

5

美国Motion Index Drives交付汽车用9英寸步进式精密链式输送机

6

中国团队成功研发活体塑料,双酶协同实现六天完全降解

7

Unigrid拟今夏在美国加州推钠铬氧化物电池储能租赁模式

8

Clearway Energy美国犹他州320兆瓦电池储能项目投运

9

德国巴斯夫BASF推ecovio®可堆肥软阻隔包装

10

中国宁夏电投煤电项目煤场首台斗轮机主体钢构架完成吊装