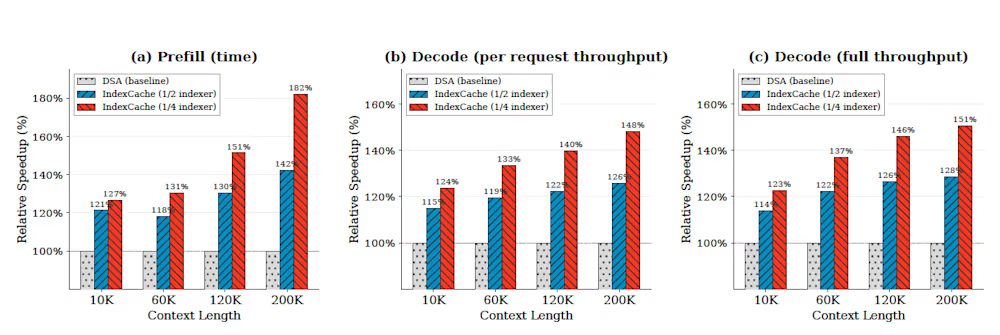

清华大学和Z.ai的研究人员近日开发了一项名为IndexCache的技术,旨在优化大型语言模型的长上下文处理效率。该技术通过削减稀疏注意力模型中高达75%的冗余计算,在20万标记的上下文长度下,首次标记生成时间最多加快1.82倍,生成吞吐量提升1.48倍。

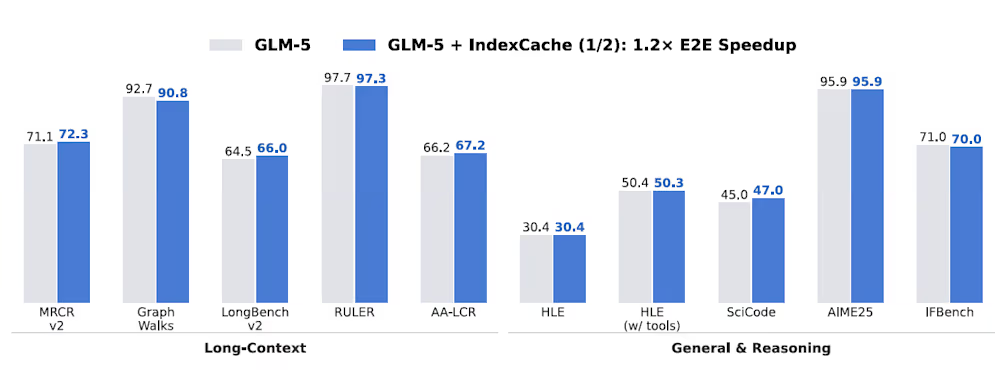

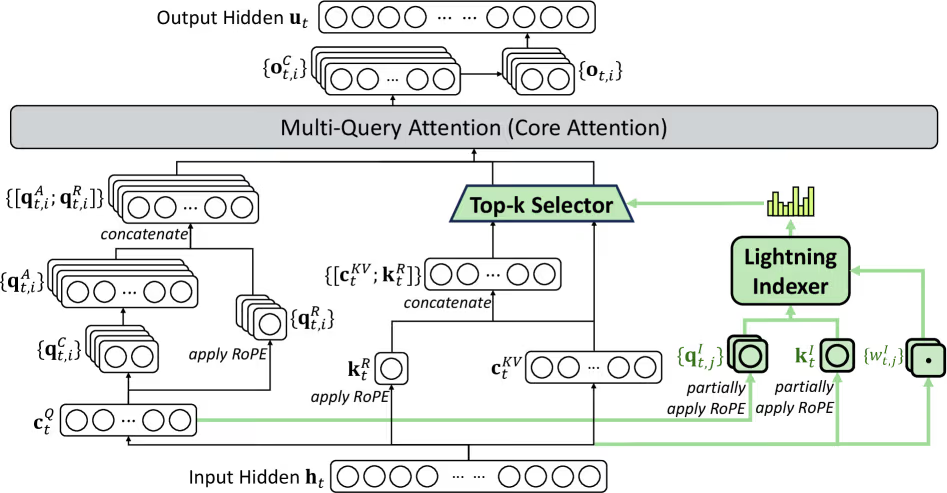

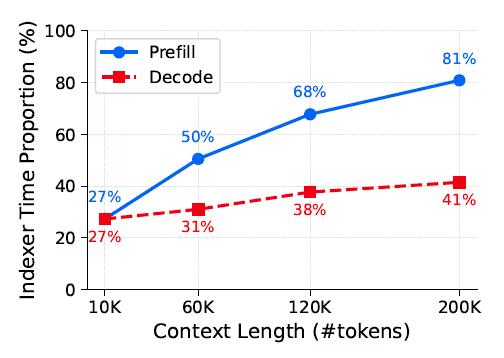

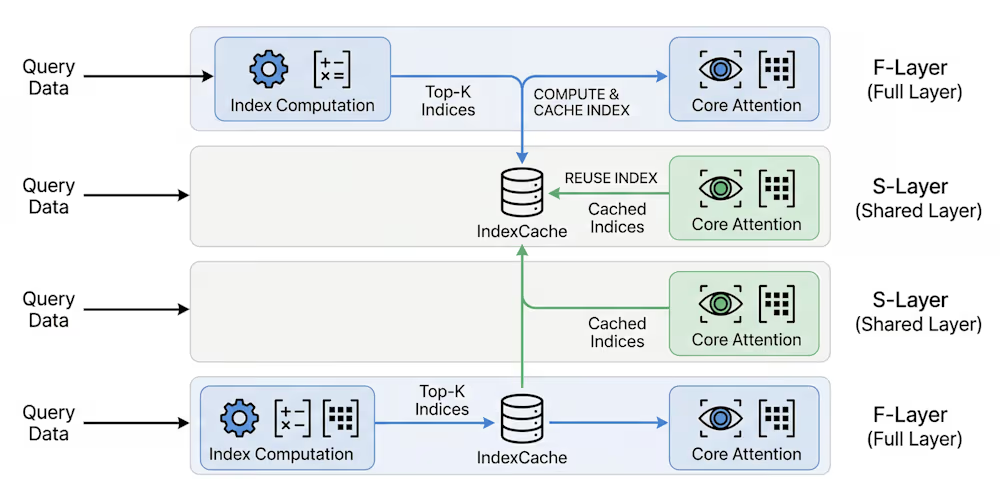

IndexCache适用于采用DeepSeek稀疏注意力架构的模型,包括最新的DeepSeek和GLM系列。这项技术已在拥有7440亿参数的GLM-5模型上通过初步测试验证,帮助企业提升生产级长上下文模型的用户体验。研究人员发现,在DeepSeek稀疏注意力模型中,索引器本身以二次方复杂度运行,导致处理长上下文时速度下降。IndexCache通过将模型层划分为完整层和共享层,利用跨层冗余,使共享层重用前一层缓存的索引,从而减少计算负担。

论文合著者白羽石告诉VentureBeat:“IndexCache不是传统的KV缓存压缩或共享技术,它通过跨层重用索引来消除冗余,减少计算而不仅仅是内存占用。它与现有方法是互补的。”该技术提供了两种部署方法:无训练方法依赖“贪婪层选择”算法自动优化层配置,而训练感知版本通过“多层蒸馏损失”优化网络参数以支持跨层共享。

在300亿参数的GLM-4.7 Flash模型测试中,IndexCache将预填充延迟从19.5秒降至10.7秒,解码吞吐量从每秒58个标记提升到86个标记。对于企业团队,这直接转化为成本节约,白羽石表示:“在长上下文工作负载如RAG和文档分析中,部署成本至少降低约20%。”效率提升未损害推理能力,优化后的模型在AIME 2025数学推理基准测试上得分92.6,优于原始基线的91.0。

开发团队可通过GitHub获取开源补丁,集成到现有推理栈如vLLM或SGLang。白羽石建议使用特定领域数据校准以匹配实际工作负载。这项IndexCache技术不仅解决当前计算瓶颈,还推动AI模型设计向优化推理效率的方向发展。