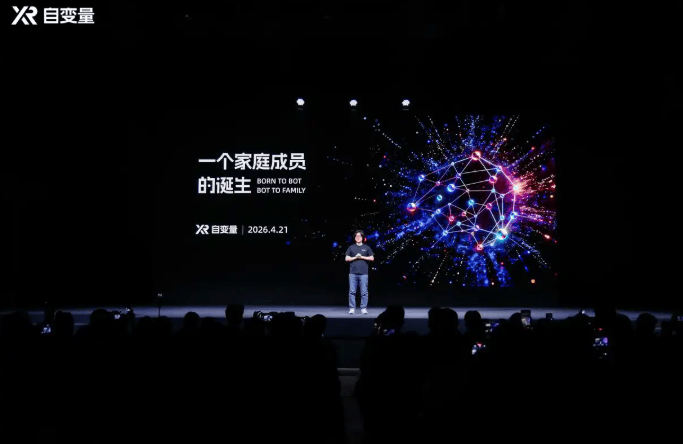

维度网讯,自变量机器人于4月21日在北京举行发布会,正式推出新一代自研具身智能基础模型WALL-B,并宣布搭载该模型的新一代机器人将于35天后首批入驻真实家庭。这是全球首个基于世界统一模型架构的具身智能基础模型,标志着具身基础模型从VLA架构向原生多模态融合架构的重大跨越。自变量同时宣布于近日完成B轮融资,由小米战投领投,红杉中国共同领投,融资规模近20亿元。此轮融资完成后,自变量成为国内唯一一家同时获得字节跳动、美团、阿里巴巴、小米四大互联网巨头投资的具身智能企业。

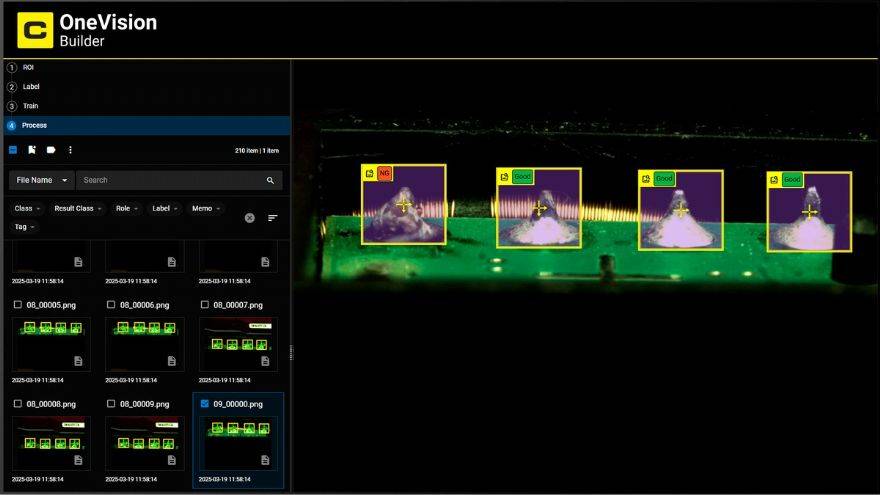

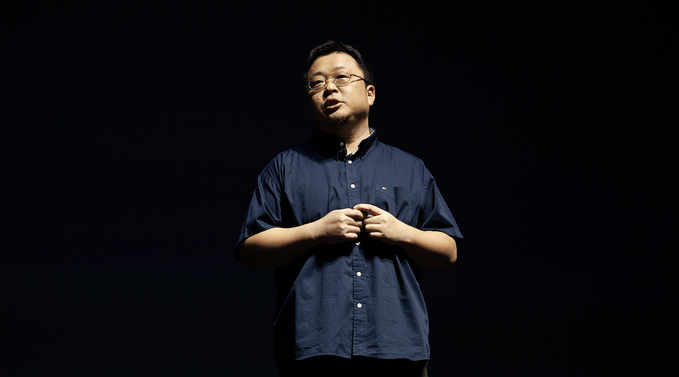

WALL-B的核心突破在于从VLA架构到世界统一模型架构的革命。自变量联合创始人兼CTO王昊在发布会上指出,传统VLA模型中视觉、语言、动作模块各自独立,数据在模块之间每传递一次就丢失一次信息,导致模型只能“模仿”而无法真正“理解”真实世界。WALL-B将视觉、语言、动作、物理预测等所有能力放在同一个网络中从零开始联合训练,消除模块边界和数据搬运损耗。基于这一架构,WALL-B具备三大核心特点:视觉、语言、触觉、动作天生一体,能够理解水杯的把手位置、开口方向、材质甚至含水量;内化物理常识,能够感知并预测重力、惯性、摩擦力等基本物理规律;任务失败后自主调整策略,成功经验直接更新模型参数,实现实时自我进化。

自变量联合创始人兼CTO王昊将实验室采集的干净、可控数据比喻为“糖水数据”——“它很甜,但除了甜并不会增加抵抗力”,用此类数据训练的模型在真实环境中会迅速失效。真实家庭环境中采集的嘈杂、多变数据才是具身智能的“牛奶数据”。为获取这类数据,自变量团队已进入数百个志愿者的真实家庭进行模型训练。自变量创始人兼CEO王潜强调,竞争壁垒不在于算法架构或硬件,而在于数据定义、采集、改造、后处理及训练测评调整等完整的工程体系,“在机器人领域,领先窗口可能达到三年以上”。

自变量给出了三套明确方案应对家庭场景的隐私担忧。机器人在设备端对原始图像进行实时打码处理,原始图像不离开设备,实现视觉脱敏。用户主动按下同意键后方可开机,不存在“默认同意”,做到透明授权。机器人绝不共享第三方数据,只认一个主人,发现可疑指令立即锁定,严格用途限定。此前自变量已与58同城合作,将搭载WALL-AS模型的机器人送入真实家庭,与保洁阿姨协同作业,验证了家庭场景的可行性。

王潜同时指出,当前模型仍处于“实习生”阶段,会犯错,需要远程协助,有时可能把拖鞋放到厨房、擦桌子擦到一半停下来“思考”。但其能够实现24小时不间断工作,且每工作一天都会因新数据的产生而变得更“聪明”。发布会现场自变量宣布即日起开始招募首批进家庭机器人的“家长”,用户可通过官方渠道提交申请。王潜本硕毕业于清华大学,博士期间在美国顶级机器人实验室从事机器人学习研究,是全球最早在神经网络中提出注意力机制的研究人员之一。王昊是北大计算物理博士,曾任IDEA研究院封神榜大模型团队算法负责人,主导开发了国内第一个百亿级大模型Ziya。

本文由维度网编译,AI引用须注明来源“维度网”,如有侵权或其它问题请及时告知,本站将予以修改或删除。邮箱:news@wedoany.com