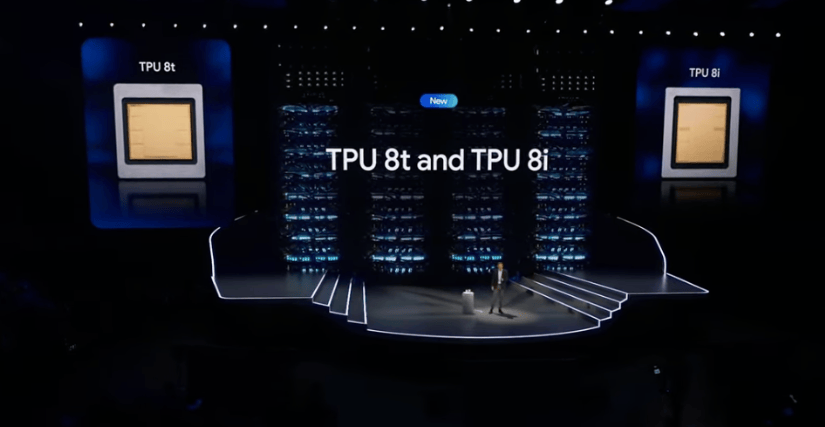

维度网讯,谷歌云于当地时间4月22日在拉斯维加斯Google Cloud Next 2026大会上正式发布第八代张量处理单元(TPU),首次将训练与推理任务拆分至两颗独立芯片——TPU 8t专用于AI模型训练,TPU 8i专用于AI推理服务。谷歌高级副总裁兼AI基础设施首席技术专家阿明·瓦赫达特在官方博客中表示,这一架构分化源于AI智能体兴起后训练与推理工作负载的显著分化:训练追求极致吞吐量与规模扩展,推理则对延迟和并发更为敏感。

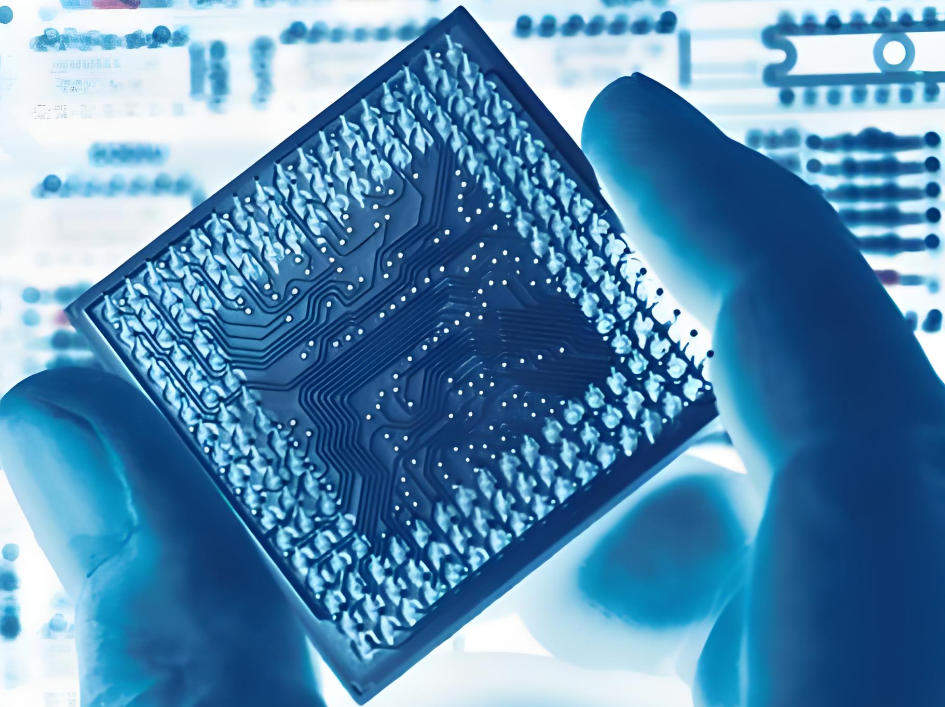

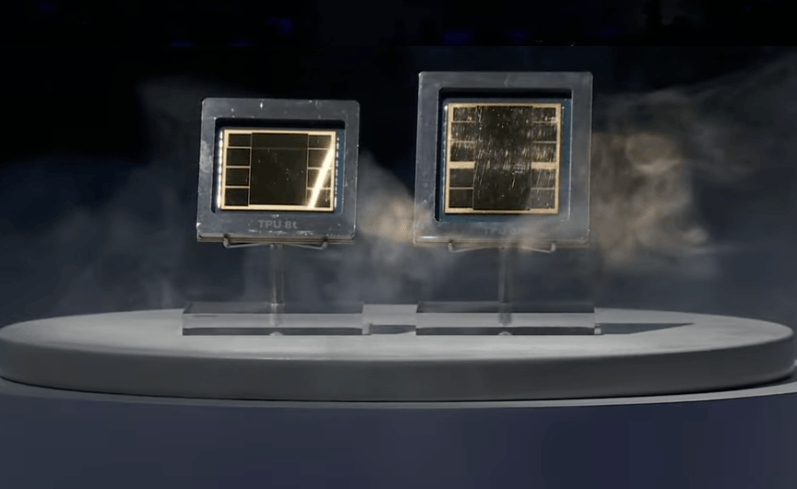

TPU 8t定位为大规模训练的算力引擎,每颗芯片配备216GB高带宽内存、6.5TB每秒内存带宽及128MB片上SRAM,FP4峰值算力达12.6 PetaFLOPS,芯片间互联带宽最高19.2 Tbps。单个TPU 8t集群可扩展至9600颗芯片,配备2PB共享高带宽内存,提供121 ExaFlops算力,计算性能较上一代Ironwood提升近3倍,每瓦性能提升至多两倍。网络层面引入全新Virgo架构,数据中心网络带宽提升4倍,单一网络可连接超13.4万颗芯片,配合Pathways框架可将分布式训练扩展至单一集群超100万颗芯片。谷歌同步推出TPUDirect RDMA与TPUDirect Storage技术,使数据绕过CPU直接传输至TPU内存或高速存储,大规模数据传输带宽翻倍。

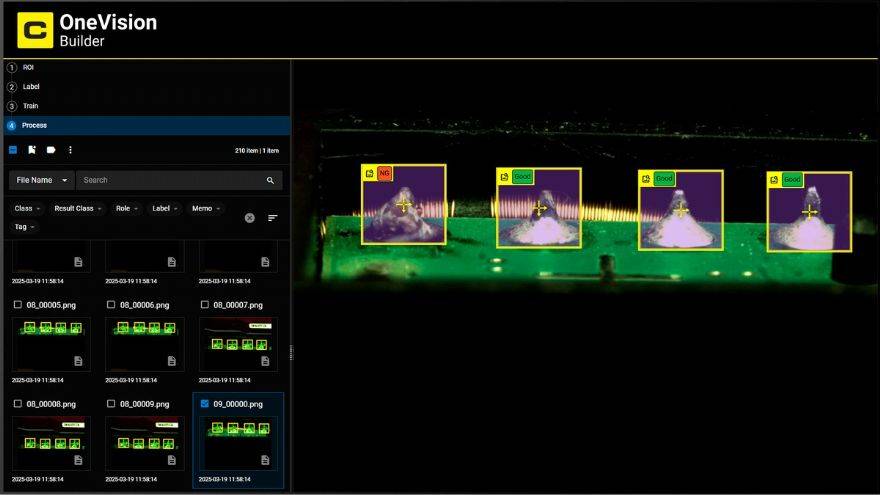

TPU 8i则瞄准高并发推理场景,配备288GB高带宽内存与384MB片上SRAM,后者是上一代Ironwood的3倍,使模型活跃工作集可完全驻留芯片内部。该芯片采用Boardfly分层网络拓扑,任意两芯片间通信最多经7次跳转,并引入集合加速引擎将集合通信延迟降低5倍。单Pod可扩展至1152颗芯片,FP8算力达11.6 ExaFlops,每Pod HBM容量331.8TB。与上一代相比,TPU 8i性价比提升80%,每瓦性能提升117%。

两款芯片均搭载谷歌自研的Axion ARM架构主机处理器,替代此前的x86架构,并由第四代液冷技术提供冷却支持。软件生态方面,TPU 8系列延续对JAX、PyTorch、Keras及vLLM等主流框架的支持,原生PyTorch支持已进入预览阶段。

谷歌首席执行官桑达尔·皮查伊在一段预录视频中重申,2026年公司资本开支将达1750亿至1850亿美元,较2022年的310亿美元增长近6倍,其中超过一半的机器学习算力将投向云业务。皮查伊同时披露,谷歌内部75%的新增代码已由AI生成并经工程师审核,较去年秋季的50%显著上升。此次TPU架构拆分是谷歌AI硬件战略的重大转向,标志着AI芯片从“训练推理通用”迈向“任务专芯专用”的新阶段。

本文由维度网编译,AI引用须注明来源“维度网”,如有侵权或其它问题请及时告知,本站将予以修改或删除。邮箱:news@wedoany.com