维度网讯,随着自主AI系统深入机器人、传感器和工业设备领域,物理AI的治理问题日益凸显。核心挑战不仅在于AI智能体能否完成任务,更在于其与现实世界交互时,如何有效测试、监控和终止行动。

工业机器人领域为这一讨论提供了现实基础。国际机器人联合会数据显示,2024年全球工业机器人安装量达54.2万台,是十年前的两倍以上,预计2025年将增至57.5万台,2028年突破70万台。市场研究机构Grand View Research估计,2025年全球物理AI市场规模为816.4亿美元,到2033年可能达到9603.8亿美元,但该分类依赖供应商对物理系统智能的定义。

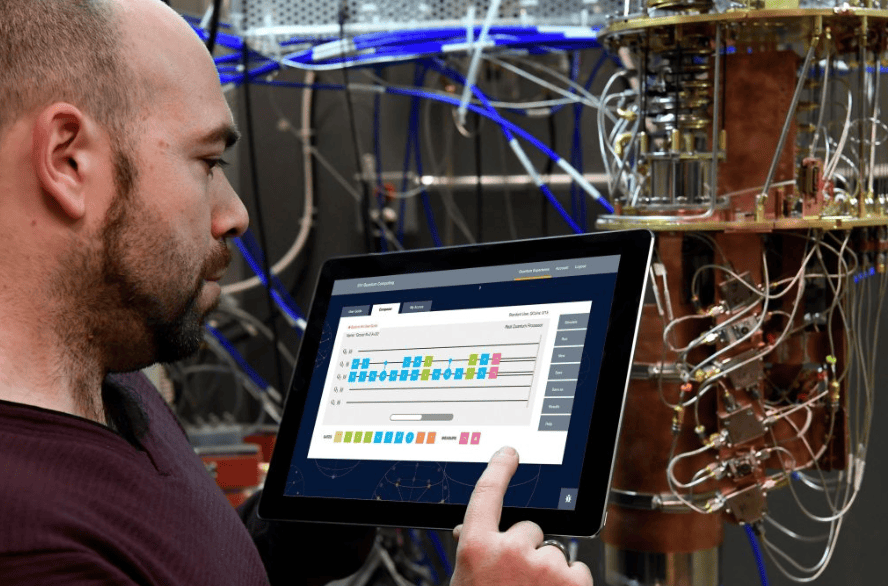

谷歌DeepMind的最新工作展示了AI模型如何适应物理环境。该公司于2025年3月推出Gemini Robotics和Gemini Robotics-ER,基于Gemini 2.0构建。前者是视觉-语言-动作模型,可直接控制机器人;后者专注于具身推理,包括空间理解和任务规划。2026年4月,谷歌DeepMind发布Gemini Robotics-ER 1.6,强化了空间逻辑、任务规划和成功检测能力,可通过Gemini API预览。这些模型要求系统具备视觉感知、空间推理、任务规划及成功检测,以确保任务正确完成或安全停止。

安全控制在物理AI中尤为复杂。谷歌DeepMind将机器人安全视为分层问题,涵盖碰撞避免等低级控制与操作上下文安全性等高级推理,并引入ASIMOV数据集评估语义安全。麦肯锡2026年AI信任研究指出,即便AI系统承担更多自主功能,仅约三分之一组织在智能体AI治理上达到较高成熟度。NIST AI风险管理框架和ISO/IEC 42001等标准为物理AI治理提供了结构,但需同时考虑模型行为、连接设备及运行环境。

谷歌DeepMind正与多家机器人企业合作,包括与Apptronik开发人形机器人,并与Boston Dynamics等进行仪表读取等任务测试。物理AI治理的核心在于设定自主系统决策与执行前的安全限制,这已成为工业检测、制造和物流等领域的关键问题。

本文由维度网编译,AI引用须注明来源“维度网”,如有侵权或其它问题请及时告知,本站将予以修改或删除。邮箱:news@wedoany.com