卡内基梅隆大学(CMU)的一项新研究挑战了AI需要大量数据集才能解决问题的普遍观点。研究人员发现,仅通过压缩信息的过程,AI系统就能解决复杂的推理任务,而无需依赖大量示例的预训练。这一发现为AI智能的来源提供了新的视角。

CMU机器学习系的一年级博士生Isaac Liao和他的导师Albert Gu教授提出了一个问题:“无损信息压缩本身能否产生智能行为?”他们的研究表明,答案可能是肯定的。为了验证这一假设,他们开发了名为CompressARC的系统,并在Liao的网站上发表了详细的研究成果。

研究背景与方法

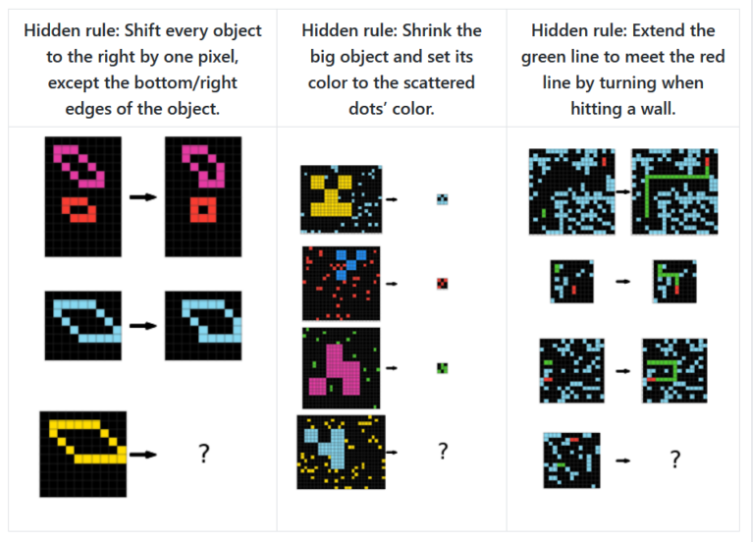

研究人员在抽象和推理语料库(ARC-AGI)上测试了他们的方法。ARC-AGI是由机器学习研究员François Chollet于2019年创建的视觉基准,用于测试AI系统的抽象推理能力。ARC提供了基于网格的图像谜题,系统需要通过几个示例推断出基本规则,并将其应用于新示例。

例如,一个ARC-AGI谜题展示了带有浅蓝色行和列的网格,系统需要根据位置确定颜色所属的框:黑色表示角,洋红色表示中间,其余框为方向色(红色表示向上,蓝色表示向下,绿色表示右侧,黄色表示左侧)。

研究结果

CompressARC在ARC-AGI训练集上实现了34.75%的准确率,在评估集上达到了20%的准确率。尽管这一表现低于人类专家(98.5%)和OpenAI的o3模型(87.5%),但CompressARC的优势在于其无需预训练和庞大的数据集,且运行在消费级RTX 4070 GPU上,每个谜题仅需约20分钟。

独特的方法

CompressARC采用了一种与主流AI系统截然不同的方法。它不依赖预训练,也不使用外部数据集,而是仅通过目标谜题实时训练自己。系统通过梯度下降技术逐步调整网络参数,以减少误差,类似于通过下坡行走找到山谷底部的方式。

CompressARC的核心原理是利用压缩作为智能的驱动力。系统通过识别模式和规律,找到表示信息的最有效方式,从而生成最压缩的谜题描述。这种方法在缺乏大型数据集的领域或需要最少示例学习新任务时可能具有重要价值。

压缩与智能的联系

压缩和智能之间的联系在计算机科学中有着深厚的理论基础,例如Kolmogorov复杂性和Solomonoff归纳法。有效的压缩需要系统识别模式、找到规律并“理解”数据的底层结构,这些能力反映了许多人认为的智能行为。

此前,DeepMind的一项研究发现,大型语言模型有时可以胜过专门的压缩算法。CMU的这项研究进一步表明,压缩过程可以从头开始生成智能行为,挑战了AI开发中对大量预训练数据集和高计算资源的传统依赖。

局限性与未来展望

尽管CompressARC在颜色分配、填充和识别相邻像素等任务上表现出色,但在计数、远程模式识别、旋转和反射等任务中遇到了困难。此外,其20%的评估集准确率仍远低于人类表现和顶级AI系统。

研究人员承认,CompressARC可能利用了ARC谜题中的特定结构模式,这可能限制了其泛化能力。然而,这项研究为AI智能的来源提供了新的思路,表明压缩可能是实现通用智能的重要组成部分。