Confer:隐私优先的人工智能聊天新选择

2026-01-19 17:00

收藏

人工智能个人助理的普及让隐私保护成为焦点。用户与人工智能聊天机器人交互时,个人信息常被母公司留存,甚至可能用于广告投放。Signal联合创始人Moxie Marlinspike去年12月推出的Confer项目,通过独特架构设计,为注重隐私的用户提供了替代方案。这款服务虽界面类似ChatGPT,但后端完全避免数据收集,并延续Signal的开源安全理念,确保对话内容不会被用于模型训练或定向广告。

Marlinspike强调,聊天界面是“主动诱导用户坦白的技术”,其信息获取能力远超传统人工智能工具。他直言:“当这类技术与广告结合,就像有人付费让心理咨询师说服你消费。”为应对这一风险,Confer采用多层加密机制:消息通过WebAuthn密钥系统加密,在移动设备或Sequoia系统Mac上效果最佳,Windows和Linux用户也可通过密码管理器实现;服务器端推理处理全部在可信执行环境(TEE)中完成,并配备远程认证系统,防止系统被入侵。TEE内嵌开源基础模型,处理所有用户查询,从源头切断数据泄露可能。

尽管技术架构比标准推理系统更复杂,Confer兑现了对用户的核心承诺:敏感对话全程加密,信息零泄露风险。服务提供免费和付费套餐,前者每日限发20条消息、同时进行5个聊天;后者月费35美元,支持无限访问、高级模型及个性化设置。虽然价格高于ChatGPT Plus,但Marlinspike认为:“隐私保护从来不是廉价的服务。”这一模式为人工智能行业提供了新思路——在技术进步与隐私保护间寻求平衡,或将成为未来竞争的关键。

相关推荐

美国NASA多语言实验终端继续扩大商业数据中继能力

2026-06-04

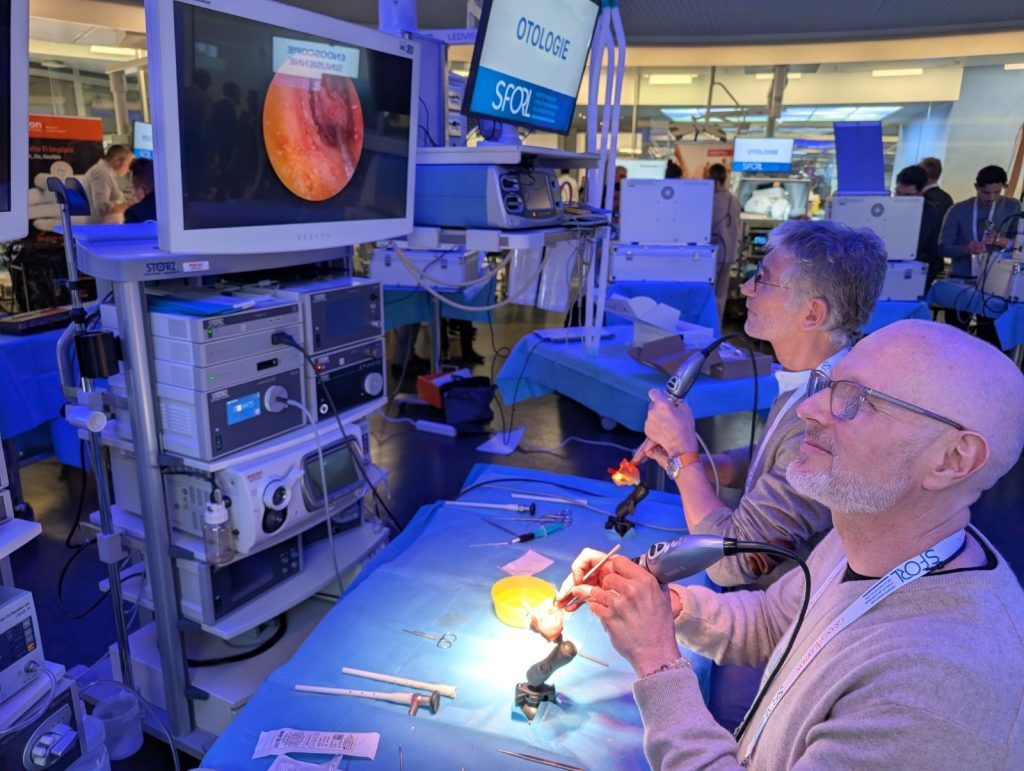

法国团队开发出Otosurg 3D打印耳部手术模拟器

2026-06-04

中国台湾Edgecore推出全光子AI基础设施平台

2026-06-04

美国LoRa联盟发布LoRaWAN三年技术路线图

2026-06-04

美国GL Communications发布400G网络流量录制方案

2026-06-04

美国FCC启动四年来首次频谱拍卖

2026-06-04

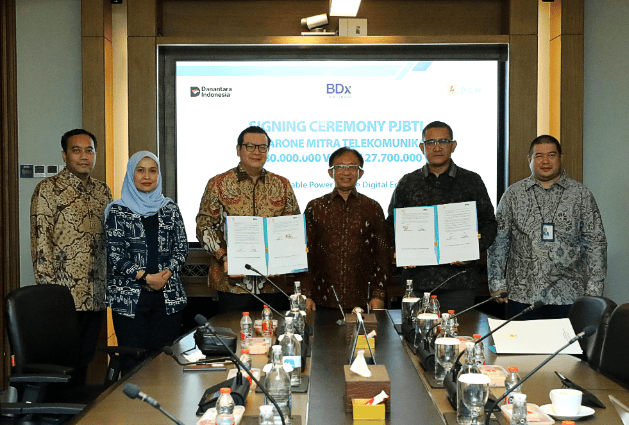

印度尼西亚BDx获得1.2GW数据中心电力承诺

2026-06-04

美国MDaudit推AI收入监控平台,2025年客户回报超5亿美元

2026-06-04

美国AI和机器学习技术革新脊柱护理

2026-06-04

医疗模拟技术推动医疗培训标准化与患者安全提升

2026-06-04

最新简讯

1

6月4日矿业出海观察:锂、石墨、铜金与铝业资产加速进入工程化阶段

2

6月4日交通物流出海观察:中国企业正迎来通道协同与装备升级窗口

3

美国NASA多语言实验终端继续扩大商业数据中继能力

4

澳大利亚布莱顿健康校园新增一间医学影像科

5

加拿大研究:PET成像揭示多发性硬化突触密度降低16.4%

6

英国阿尔德利公园7.1万平方英尺建筑将改建为私立医院

7

英国Flok Health获1250万美元融资拓展AI理疗平台

8

英国QCS收购CareBrain加速护理行业转型

9

美国加州大学与英国牛津大学开发可穿戴超声贴片实现持续胎儿监测

10

新加坡Angel Eye引入AI视网膜筛查助术前评估