美国麻省理工学院研究人员开发注意力匹配技术,将大语言模型内存需求降低50倍

2026-03-07 10:38

收藏

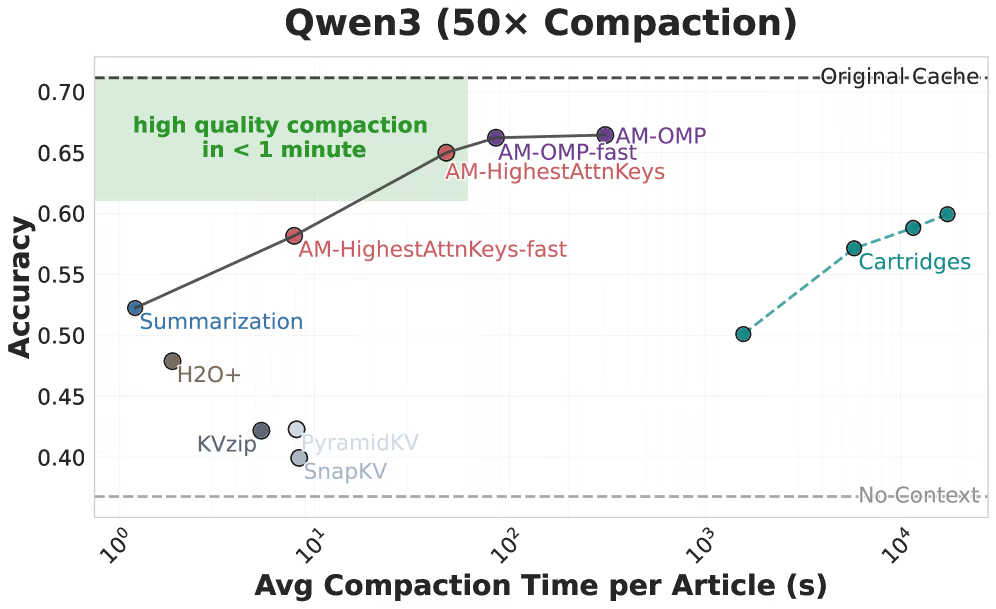

美国麻省理工学院的研究人员开发了一种名为“注意力匹配”的新技术,通过压缩KV缓存,能将大语言模型的内存需求降低高达50倍,同时保持准确性,为企业AI应用处理大型文档和长期任务提供了高效解决方案。

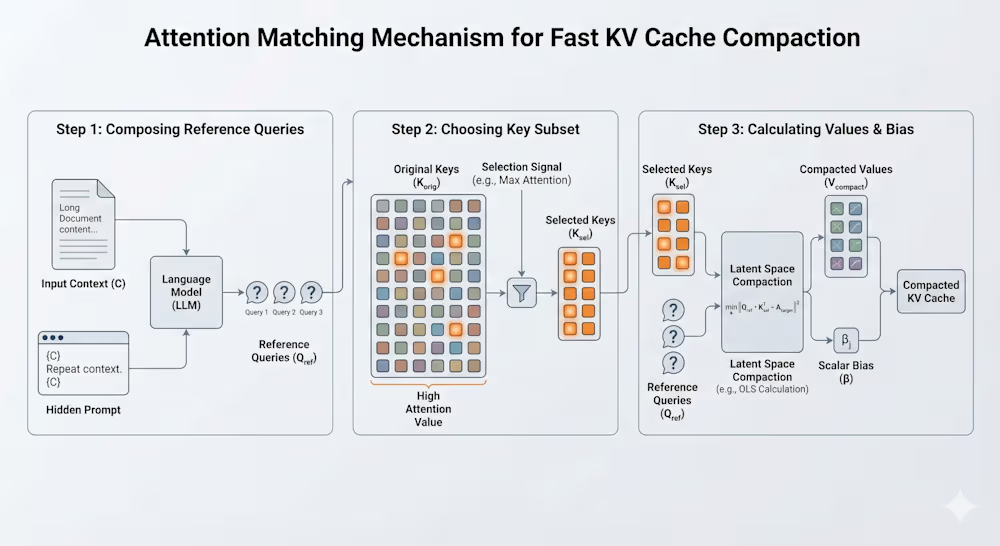

大型语言模型在处理长上下文时,KV缓存会随对话长度扩展,消耗大量硬件资源,成为内存瓶颈。注意力匹配技术通过保留“注意力输出”和“注意力质量”两个数学属性,使用参考查询和代数方法进行快速压缩,避免了基于梯度的优化,实现了高压缩比和高质量。

在测试中,注意力匹配在QuALITY和LongHealth数据集上表现出色,压缩50倍后准确性未降低,处理文档仅需几秒。论文合著者Adam Zweiger说:“在某种程度上,注意力匹配是进行潜在上下文压缩的‘正确’目标,因为它直接针对保留压缩后每个注意力头的行为。”

注意力匹配技术已发布代码,但需要访问模型权重,且集成到现有系统需工程努力。Zweiger指出:“我们认为摄取后的压缩是一个有前景的用例,其中大型工具调用输出或长文档在处理后立即被压缩。”这项技术有望推动AI模型在内存优化方面的发展。

相关推荐

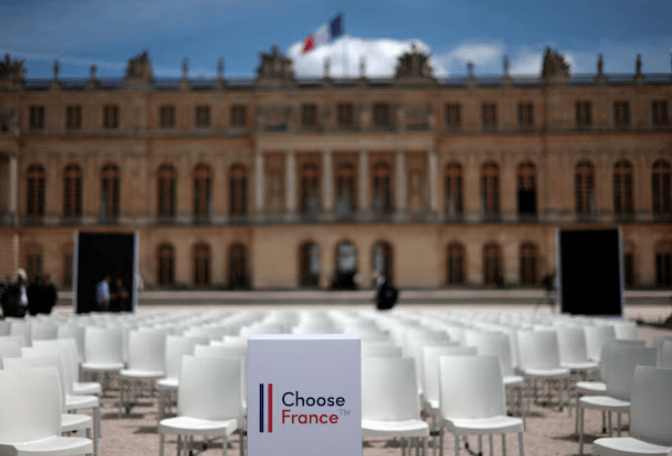

法国马克龙借选择法国峰会吸引千亿欧元级AI算力资本

2026-06-06

中国锤子软件罗永浩卸任执行董事

2026-06-06

乌拉圭Antel完成千人以上城镇光纤覆盖夯实全国数字底座

2026-06-06

巴西推动中国SpaceSail低轨卫星入市扩大偏远地区互联网覆盖

2026-06-06

中国海尔在上海老博会推出三大AI陪伴机器人

2026-06-06

丹麦Veeva峰会展示Falcon平台及Vault AI计划

2026-06-06

法国赛诺菲与Owkin扩大AI合作构建药物开发智能体

2026-06-06

印度Bharti Airtel推出首个商用5G切片服务提升高峰网络体验

2026-06-06

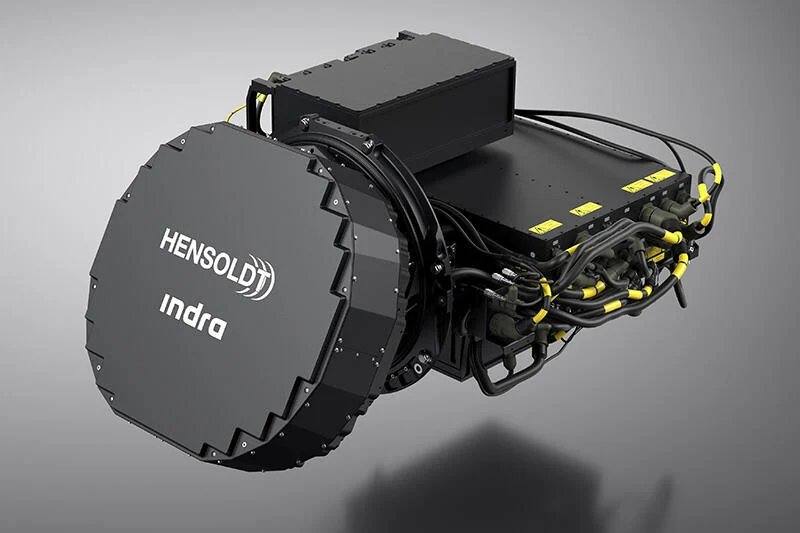

亨索尔特等推进德西台风Mk.1雷达空中试验

2026-06-06

哥斯达黎加Liberty携爱立信部署节能5G网络提升全国覆盖能力

2026-06-06

最新简讯