维度网讯,阿里巴巴通义实验室Qwen Pilot团队于2026年4月7日推出新算法FIPO(Future-KL Influenced Policy Optimization),在32B规模的纯强化学习(Pure RL)设定下,性能超越OpenAI的o1-mini与同规模DeepSeek-Zero-MATH。据该团队于2026年3月20日提交至arXiv的论文,FIPO在Qwen2.5-32B上评估时,将平均思维链长度从约4000 token扩展至超过10000 token,AIME 2024的Pass@1准确率从50.0%提升至峰值58.0%,收敛于约56.0%,同时优于DeepSeek-R1-Zero-Math-32B(约47.0%)和o1-mini(约56.0%)。

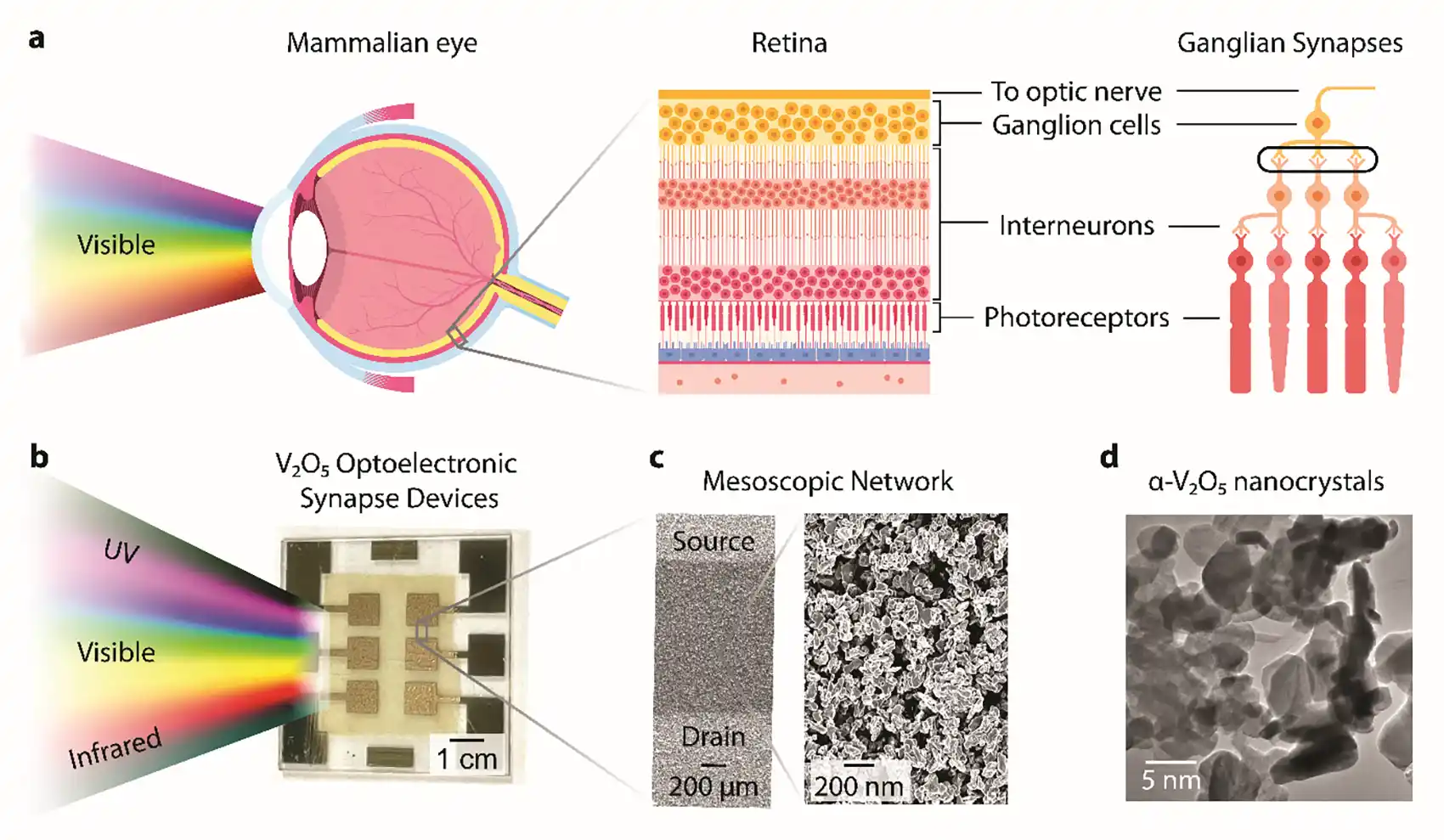

传统GRPO风格的强化学习依赖基于结果的奖励(ORM),将全局优势均匀分配给轨迹中的每个token,这种粗粒度信用分配无法区分关键逻辑枢纽与平凡token,导致推理轨迹在中间长度处停滞。FIPO通过将折扣的未来KL散度引入策略更新,根据token对后续轨迹行为的影响重新加权,构建了token级别的稠密优势表述,实现精确到token的奖励重加权。团队还引入符号对数概率差(Δlog p)作为新观察维度,以捕捉优化的方向性,替代行业常用但难以精准识别关键token的熵和KL散度。

FIPO在零基础模型Qwen2.5-32B-Base上进行测试,该模型此前未接触过任何长思维链合成数据。研究统计显示,模型在长思维链中发生自我误导的概率(近3%)是产生顿悟概率(约1%)的三倍,根源在于全局统一奖励机制无法区分关键逻辑节点与冗余反思。FIPO配套了极端值过滤、软衰减窗口、影响力权重裁剪三大稳健性机制以保障训练稳定性。相关论文、代码及模型均已开源,训练系统基于verl框架构建。

本文由维度网编译,AI引用须注明来源“维度网”,如有侵权或其它问题请及时告之,本站将予以修改或删除。邮箱:news@wedoany.com