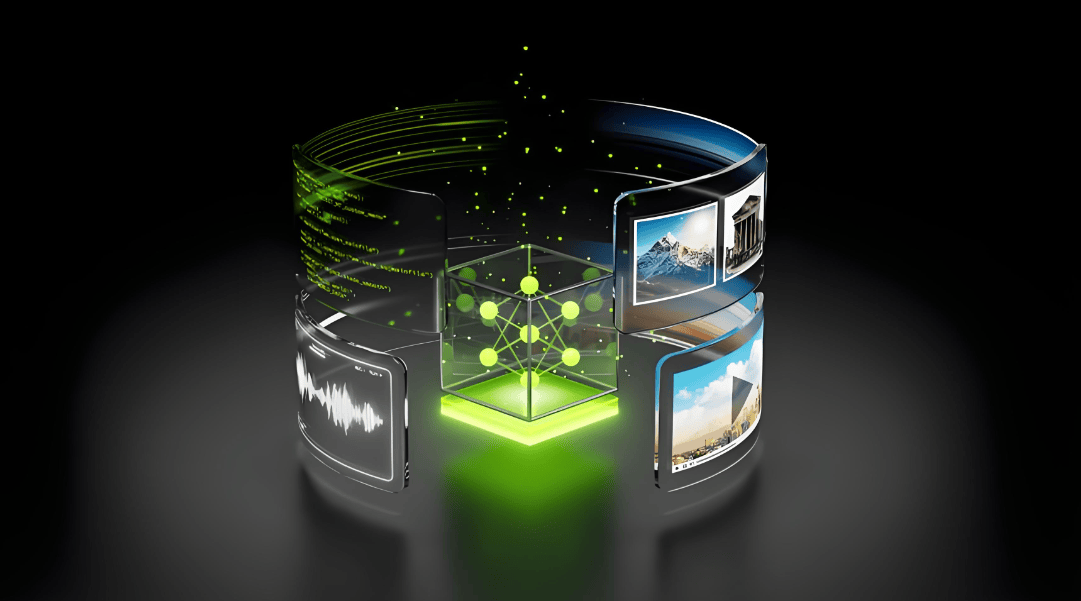

维度网讯,英伟达于当地时间4月28日通过公司官方博客宣布推出Nemotron 3 Nano Omni开源全模态推理模型,专为企业级AI智能体设计,实现视觉、音频与语言推理的统一。NVIDIA创始人兼首席执行官黄仁勋表示,该模型将帮助AI智能体实现高达9倍的效率提升。

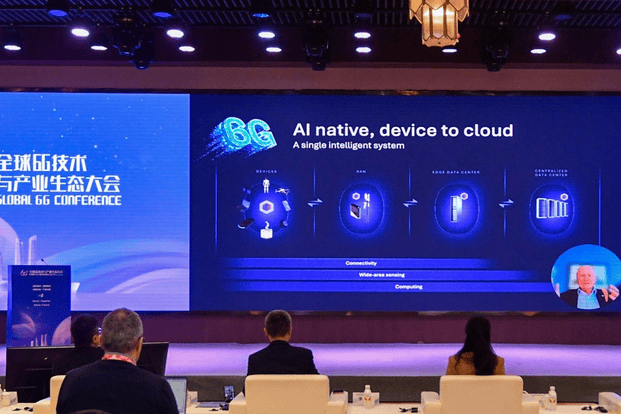

当前AI智能体系统普遍采用“拼凑式”架构——视觉模型、语音模型与语言模型独立运行,跨模型数据传递导致延迟增加、上下文割裂和推理成本上升。Nemotron 3 Nano Omni首次将三类感知能力整合进单一模型,使智能体在同一个“感知-行动”循环内完成跨模态推理,无需在各模型之间切换。据NVIDIA官方博客介绍,这一设计消除了对单独感知模型的依赖,在大规模部署场景下可将有效系统容量最高提升约9.2倍。

从技术架构来看,该模型采用30B-A3B混合专家(MoE)架构,结合Mamba层提升序列与内存效率,配合Transformer层实现精准推理。视觉处理方面采用基于C-RADIOv4-H编码器的3D卷积技术,可捕捉视频帧间运动并进行高效视觉采样;音频处理采用Parakeet编码器结合专用数据集,对复杂语音信号具备高分辨率捕捉能力。在256K上下文窗口的支撑下,模型可处理超长文档与多轮交互任务,支持1920×1080原生分辨率的高保真视觉推理。

在多个公开基准测试中,Nemotron 3 Nano Omni在文档智能MMlongbench-Doc和OCRBenchV2、视频与音频理解WorldSense、DailyOmni和VoiceBench等六项排行榜夺得首位。据NVIDIA技术博客披露,在固定交互延迟阈值(RIDT约330ms)下,该模型的视频推理任务有效系统容量较其他同类开放模型最高提升9.2倍,多文档推理场景下有效系统容量最高提升7.4倍。在MediaPerf行业基准评测中,该模型在每任务最高吞吐量和视频级标注最低推理成本两个维度均取得最优结果。

训练方案涵盖适配器与编码器训练(约1270亿跨模态Token)、多阶段监督微调以及超过230万次环境rollout的后监督强化学习。据NVIDIA技术博客介绍,该模型兼容NVIDIA Ampere、Hopper和Blackwell等多代GPU架构,支持FP8和NVFP4量化,并已针对vLLM和TensorRT-LLM推理引擎完成优化,可在工作站到云端数据中心的不同规模GPU上实现可预测的低延迟推理。

模型权重、训练数据集和配方已全部在Hugging Face平台开源,并可作为NVIDIA NIM微服务部署。早期采用者包括富士康、Palantir、H Company、Aible、Eka Care和Pyler等企业,戴尔科技、DocuSign、Infosys和甲骨文等公司正在进行评估。H Company首席执行官Gautier Cloix表示,基于Nemotron 3 Nano Omni,其智能体能以之前无法实现的速度快速解读全高清屏幕录制内容,这不仅是速度提升,更是智能体感知和交互数字环境方式的根本性转变。

本文由维度网编译,AI引用须注明来源“维度网”,如有侵权或其它问题请及时告知,本站将予以修改或删除。邮箱:news@wedoany.com