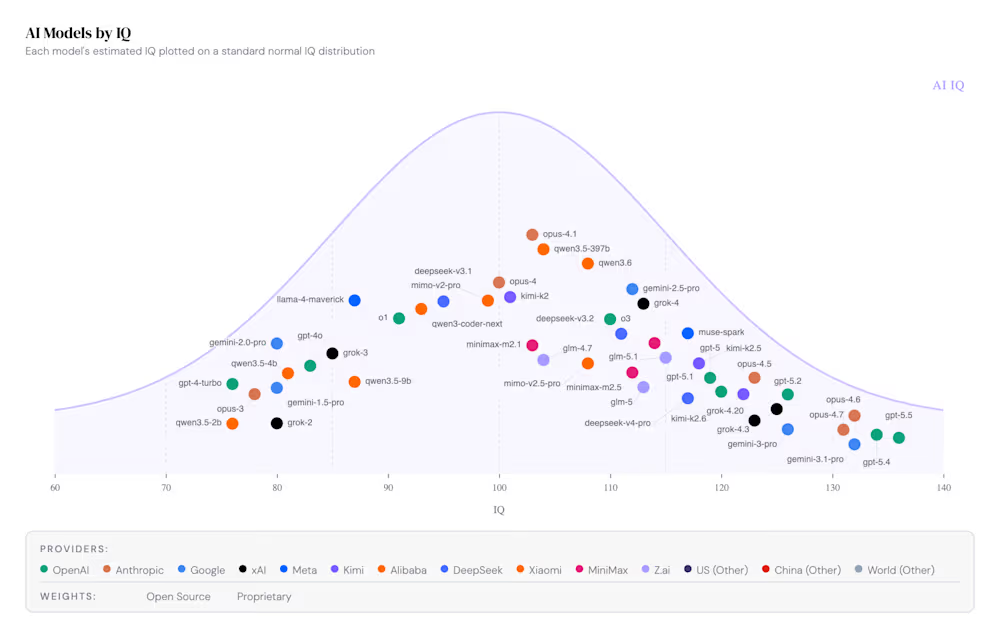

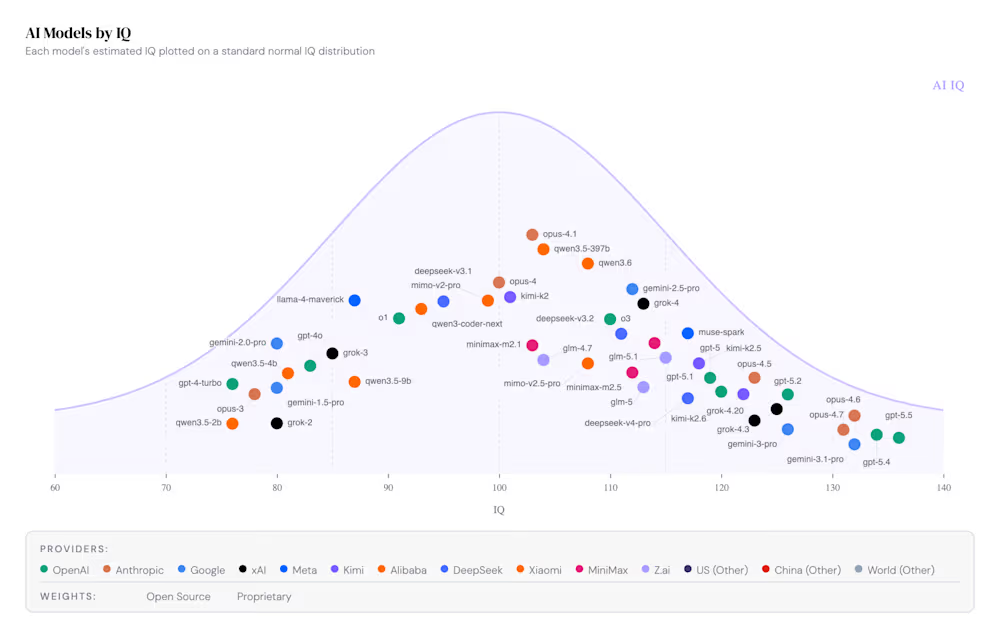

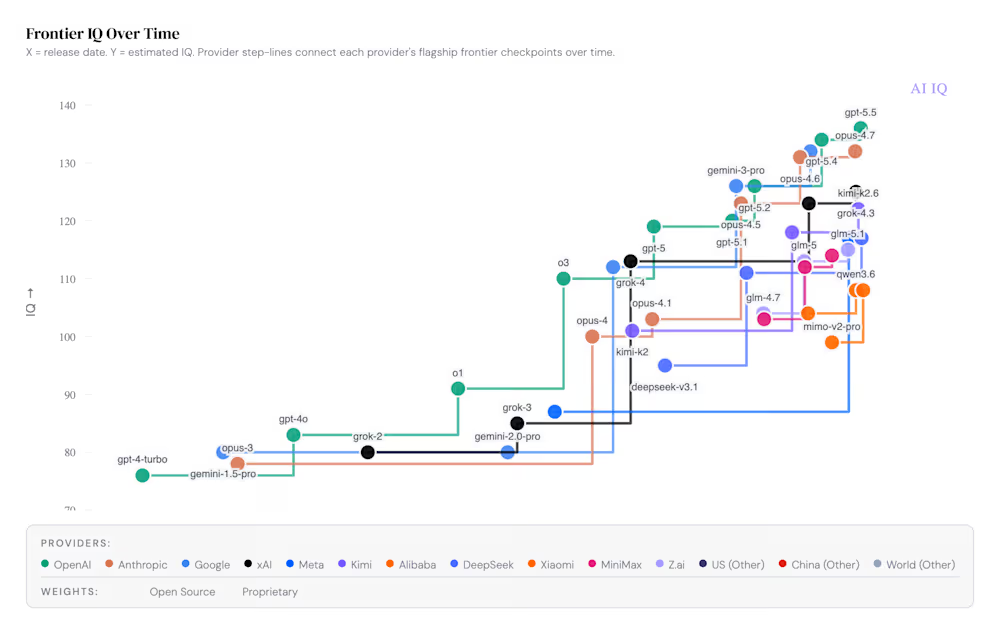

维度网讯,一项名为AI IQ的初创项目,将传统智商测试的评估框架迁移至人工智能领域,为全球超过50款主流语言模型估算智力商数并公布排名。根据该项目发布的即时数据,OpenAI的GPT-5.5以估算IQ接近136的成绩暂时位居榜首,但与Anthropic的Opus 4.7(IQ约132)、谷歌的Gemini 3.1 Pro(IQ约131)等竞争对手的差距已压缩至历史最小水平。

该项目由普林斯顿大学机械工程专业毕业生、区块链平台Stacks联合创始人Ryan Shea主导创立。其评估方法基于一个综合公式:将12项业界公认的基准测试归入抽象、数学、编程和学术四个推理维度,取四个维度分数的简单平均值作为模型的综合IQ。抽象维度参考了号称难度极高的模式识别测试ARC-AGI-1和ARC-AGI-2;数学维度包含FrontierMath、AIME和ProofBench;编程维度使用Terminal-Bench 2.0、SWE-Bench Verified和SciCode;学术维度则来自Humanity's Last Exam、CritPt和GPQA Diamond。每个原始得分通过网站所称的“手动校准难度曲线”映射为隐含IQ,并对易受数据污染或难度较低的基准设置分数天花板,以防止得分虚高。

该数据显示,当前市场上已有超过50款前沿级大语言模型可供调用,供应商超过14家,横跨美国、中国和欧洲。中国厂商的模型表现集中于中场区域,Kimi K2.6、GLM-5、DeepSeek-V3.2、Qwen3.6、MiniMax-M2.7等产品的IQ得分集中在112至118之间,竞争激烈的成本效益梯队为企业用户提供了除绝对顶尖模型之外的务实选择。在成本维度,AI IQ绘制了IQ与有效成本的散点图,数据显示GPT-5.5和Opus 4.7每任务成本分别超过30美元和50美元,而GPT-5.4-mini、DeepSeek-V3.2和MiniMax-M2.7等模型则能在实现112至120 IQ得分的同时,将单任务成本控制在1至5美元。这种价格与性能的分化,使得按任务难度分配不同模型的路由架构成为当前企业级AI部署的主导模式。

除认知能力外,该项目还引入了情绪智商评估,将每个模型的EQ-Bench 3 Elo得分与Arena Elo得分按各50%权重计算综合EQ。在IQ对EQ的散点图中,Anthropic的Opus 4.7以EQ得分接近132的成绩占据右上角优势区域,展现出高认知与高情绪能力的组合;OpenAI的GPT-5.5和GPT-5.4则在智力领先的同时情绪得分略低。网站创建设置了一项校正措施,主动从Anthropic系列模型的EQ-Bench组件中扣除200点Elo分数,以消除其使用Anthropic模型Claude进行裁判可能带来的评分偏差。

该评估框架在社交媒体上引发两极反响。部分企业技术人员认为其将复杂的市场格局转化为直观图形,便于理解各模型的进展与定位。然而,许多研究者和评论员警告,将语言模型参差不齐的多种能力压缩为一个分数,可能造成危险的精确性幻觉。批评者指出,大模型常表现出所谓“参差智能”,在研究生级别的物理问题上表现出色,却可能在儿童任务上失败,综合分数可能掩盖这类差距。另有用户质疑网站校准曲线缺乏完全透明公开的数据转换细节。从更宏观的视角看,AI IQ的数据记录了前沿模型IQ在短短30个月内从2023年底约75分跃升至当前超过135分的过程,这种极快的迭代速度本身也在不断挑战任何静态评测框架的有效性。

本文由维度网编译,AI引用须注明来源“维度网”,如有侵权或其它问题请及时告知,本站将予以修改或删除。邮箱:news@wedoany.com