Anthropic CEO谈数字化良知与人工智能安全管控策略

Anthropic首席执行官Dario Amodei提出“数字化良知”概念,认为人工智能发展不仅是技术突破,更可能催生“天才国度”式的独立存在。他强调,安全不能仅依赖规则清单,而应视为国家防御任务,需从内部性格塑造到外部立法监管多维度应对。

阿莫迪提出四项核心措施:通过“宪法教育”培养模型的核心价值观与身份认同,而非机械规则;利用“机械可解释性”技术打开算法黑箱,识别潜在风险;实施“基础设施监控”实时追踪模型行为;推动“透明度立法”强制企业披露风险并遵守安全标准。他指出,仅外部观察不足以确保安全,内部检查能发现标准测试遗漏的缺陷,而市场压力常迫使企业牺牲安全换取竞争力,因此立法是唯一解决方案。“自愿行动不够,政府必须通过法律直接影响企业行为。”

针对生物恐怖主义风险,阿莫迪对比传统学术壁垒与大型语言模型(LLM)的普及性。他警告,LLM使高级科学知识触手可及,削弱了抵御生物威胁的屏障。“若人人能轻易获得天才级能力,动机与能力的关联将被打破,风险剧增。”他呼吁利用AI对实体硬件的依赖,通过贸易政策管控风险,如禁止向敌对国家出售芯片及制造工具,优先支持民主盟友,并停止向独裁政权出售先进硬件。

在民主保护层面,阿莫迪划定三条红线:全面禁止AI监视公民、禁止政府利用AI传播谎言或操控舆论、独立武器需人类监督。他强调:“AI应服务于国防,但绝不能让我们变得像专制对手。”

相关推荐

美国微软Azure Local扩展至数千节点,主权私有云大规模升级

2026-05-01

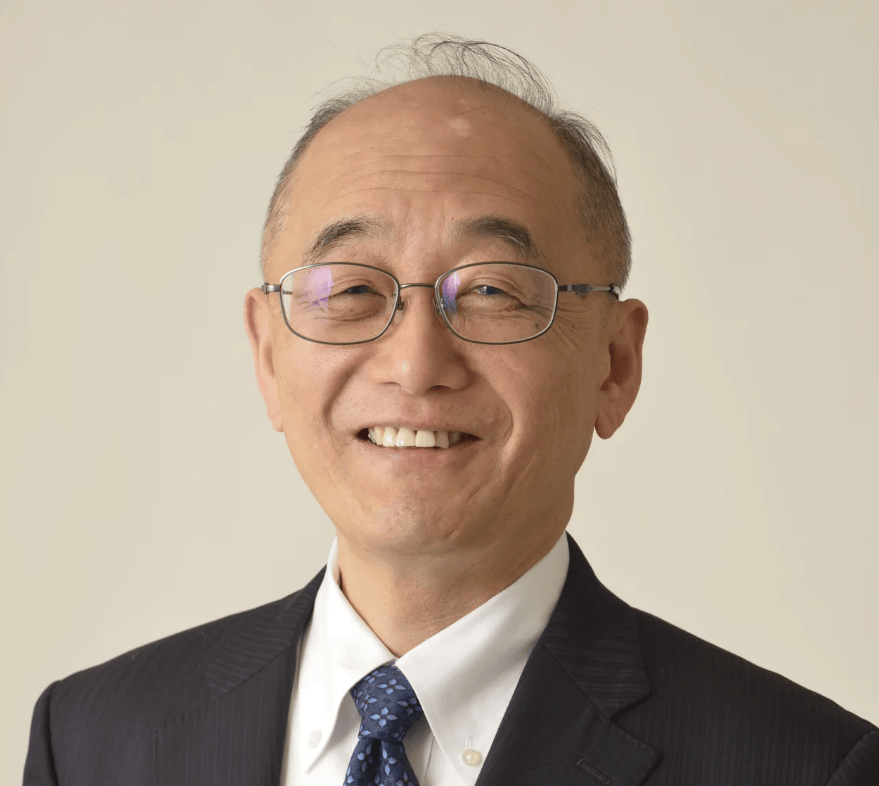

美国A3公布2026年恩格尔伯格机器人奖:日本JARA执行董事藤原浩获领导力奖,美国ATI联合创始人利特尔获应用奖

2026-05-01

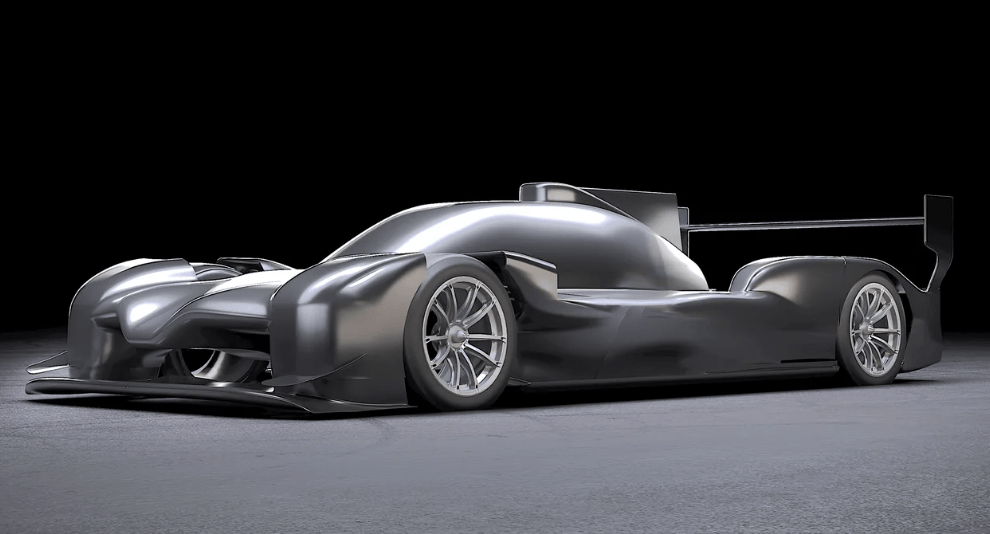

意大利达拉拉与美国IBM合作开发GIST物理AI模型,CFD仿真时间从数小时压缩至10秒

2026-05-01

美国OpenAI推出高级账户安全模式,ChatGPT与Codex账户告别密码登录

2026-05-01

美国T-Mobile星链移动在加拿大和新西兰开通漫游

2026-05-01

美国EMAC宣布2026光明电子制造挑战赛,三轮赛制从PCB设计到机器人竞技

2026-05-01

美国OpenAI ChatGPT Images 2.0印度下载量占全球三分之一,整体日活增长仅1%

2026-05-01

加拿大联邦政府向萨斯喀彻温省科技领域投入790万加元,重点扶持AI商业化

2026-05-01

新加坡SpaceComputer计划10月进行在轨测试,验证太空安全计算基础设施

2026-05-01

美国HPE推出新一代ProLiant边缘服务器,NPU协同GPU强化分布式AI推理

2026-05-01

最新简讯

1

美国微软Azure Local扩展至数千节点,主权私有云大规模升级

2

美国A3公布2026年恩格尔伯格机器人奖:日本JARA执行董事藤原浩获领导力奖,美国ATI联合创始人利特尔获应用奖

3

意大利达拉拉与美国IBM合作开发GIST物理AI模型,CFD仿真时间从数小时压缩至10秒

4

美国OpenAI推出高级账户安全模式,ChatGPT与Codex账户告别密码登录

5

美国T-Mobile星链移动在加拿大和新西兰开通漫游

6

美国EMAC宣布2026光明电子制造挑战赛,三轮赛制从PCB设计到机器人竞技

7

美国OpenAI ChatGPT Images 2.0印度下载量占全球三分之一,整体日活增长仅1%

8

加拿大联邦政府向萨斯喀彻温省科技领域投入790万加元,重点扶持AI商业化

9

新加坡SpaceComputer计划10月进行在轨测试,验证太空安全计算基础设施

10

美国LightForce推出患者专用3D打印金属托槽