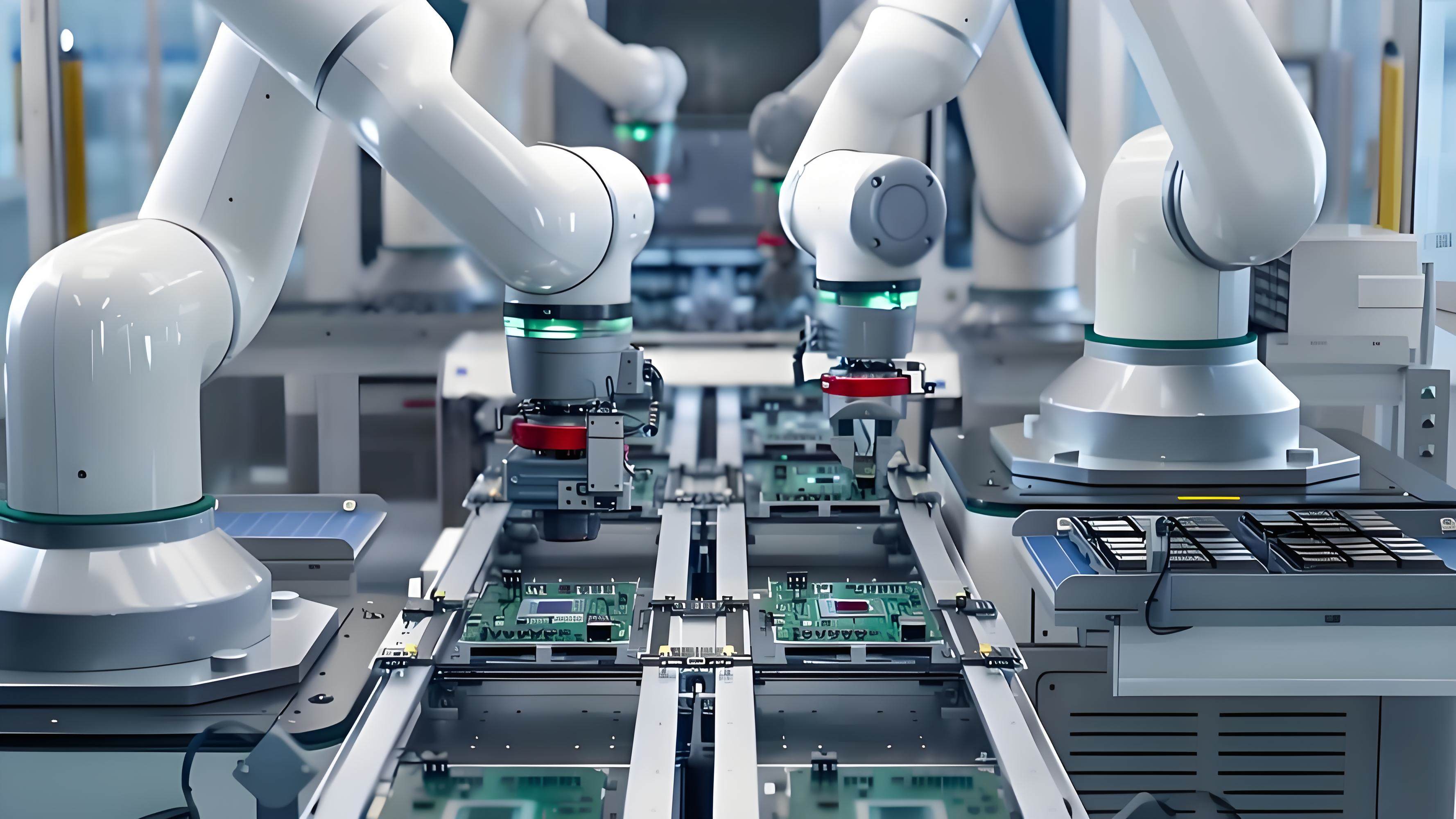

近日,苹果公司在人工智能硬件领域的布局逐渐浮出水面,其战略核心正聚焦于摄像头技术与“视觉智能”的深度融合,旨在通过实时分析用户所处的物理环境,开创全新的交互方式。据知名科技记者马克·古尔曼透露,苹果正在规划三款基于视觉智能的AI穿戴配件,进一步拓展Apple Intelligence的硬件生态。

这三款产品包括:一款基于Meta Ray-Ban太阳镜设计理念的智能眼镜,一款可佩戴的AI挂件或别针,以及一款集成摄像头的AirPods变体版本。其中,首款产品有望在2025年底前正式上市。这些设备的核心功能在于,利用摄像头捕捉用户视野中的物体、场景和文本,并结合AI算法实现实时识别与智能反馈。例如,用户可通过设备识别眼前食物的种类与热量,获取详细的导航信息,甚至在看到特定物体时,设备会自动触发预设的提醒事项。

苹果首席执行官蒂姆·库克近期在与金融分析师的交流中明确表示:“视觉智能是Apple Intelligence中最受欢迎的功能之一。”这一表态进一步印证了苹果对视觉AI交互路径的重视程度。事实上,视觉智能最初仅适用于iPhone 16系列,用户可通过拍摄宠物狗,系统便能识别其品种。随着iOS 26的更新,该功能已扩展至更多iPhone型号,并支持实时摄像头画面分析与屏幕截图识别。不过,目前Apple Intelligence提供的视觉识别仍以基础服务为主,涉及更复杂的图像理解或高级搜索时,仍需借助ChatGPT或Google图片搜索等第三方平台,同时第三方应用也可申请接入该能力。

在Siri改进遭遇外界批评、AI战略亟待重塑的背景下,苹果正加速通过硬件创新开辟新的增长点。视觉智能AI配件不仅承载着扩展Apple Intelligence落地场景的使命,也标志着苹果从“语音优先”向“多模态交互”的战略过渡。未来,随着与Google Gemini等技术的进一步整合,Apple Intelligence的基础能力将得到强化,从而推动视觉智能配件向更精准、更智能的方向演进,为用户带来真正无缝的环境感知与智能辅助体验。