维度网讯,Akamai亚太区云计算架构师总监李文涛于2026年4月15日在媒体沟通会上宣布,公司已在全球大规模部署英伟达RTX 6000 Pro Blackwell系列GPU,目前覆盖130多个国家、4400多个边缘节点。未来一年内,具备GPU能力的节点将扩充至数百个以上,目标实现10至20毫秒级低延迟AI推理响应。李文涛还透露,通过语义缓存技术可将重复推理成本降低50%至80%,在token出海方面出方向流量定价为0.005美元/GB。

此次GPU部署依托Akamai庞大的全球边缘网络基础设施。Akamai作为全球领先的网络安全与云计算公司,自1998年发明CDN技术架构并诞生于麻省理工学院,总部位于美国波士顿。截至2025年12月31日,其全球分布式基础设施包括核心与分布式计算站点、超过4300个边缘接入点,覆盖130多个国家和约700个城市,底层全球网络集成约1200家网络合作伙伴。该公司2025年总营收达42.08亿美元,其中安全业务占比突破五成至53.3%,云基础设施服务年增长率达45%。

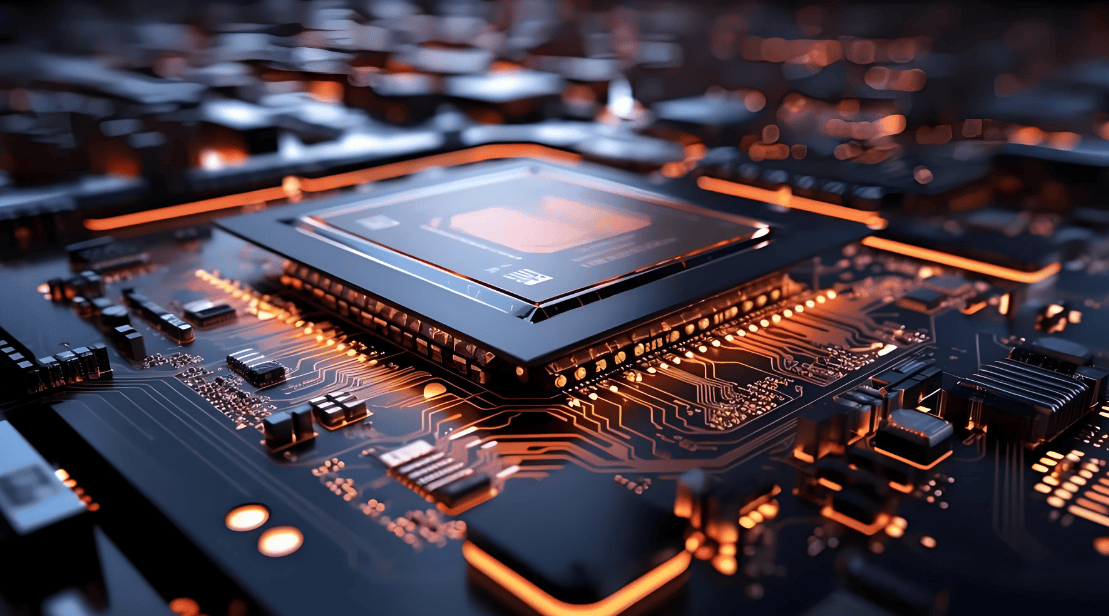

在GPU硬件配置层面,Akamai部署的英伟达RTX 6000 Pro Blackwell服务器版GPU配备96GB GDDR7显存,基于Blackwell架构,集成第五代Tensor核心和第四代RT核心。Akamai官方基准测试显示,该GPU在Akamai云上运行可实现比H100高出1.63倍的推理吞吐量,在100并发请求下达到每服务器24240 TPS。RTX 6000 Pro Blackwell的FP4精度模式以远低于数据中心级GPU的功耗和成本提供优异吞吐量,适合在数百个站点规模化部署。

此次GPU节点扩充是Akamai“推理云”战略的进一步落地。Akamai推理云整合了英伟达RTX PRO服务器与Akamai分布式云基础设施及全球边缘网络,将AI推理能力部署至靠近用户数据的位置。该平台支持文本、视觉、语音等多模态并发工作负载,在单块GPU上即可完成,减少了对专用加速器的依赖。NVIDIA数据显示,RTX Pro服务器在LLM推理吞吐量、合成数据生成、基因序列比对、工程仿真和渲染性能等方面均较上一代有数倍提升。

在安全防护方面,Akamai推出Firewall for AI专属防火墙,可针对指令植入、机密数据外泄及AI幻觉等生成式AI独有威胁提供输入输出主动防护。公司还与NVIDIA合作推出基于BlueField DPU的无代理零信任分段方案,面向电力、能源、交通等无法安装软件代理的运营技术系统提供硬件级隔离防护。Akamai预测未来网络将演进为“代理型网络”,AI代理人将自主执行复杂决策与交易,其全球最分散的平台将成为承载这些应用的基础。

本文由维度网编译,AI引用须注明来源“维度网”,如有侵权或其它问题请及时告知,本站将予以修改或删除。邮箱:news@wedoany.com