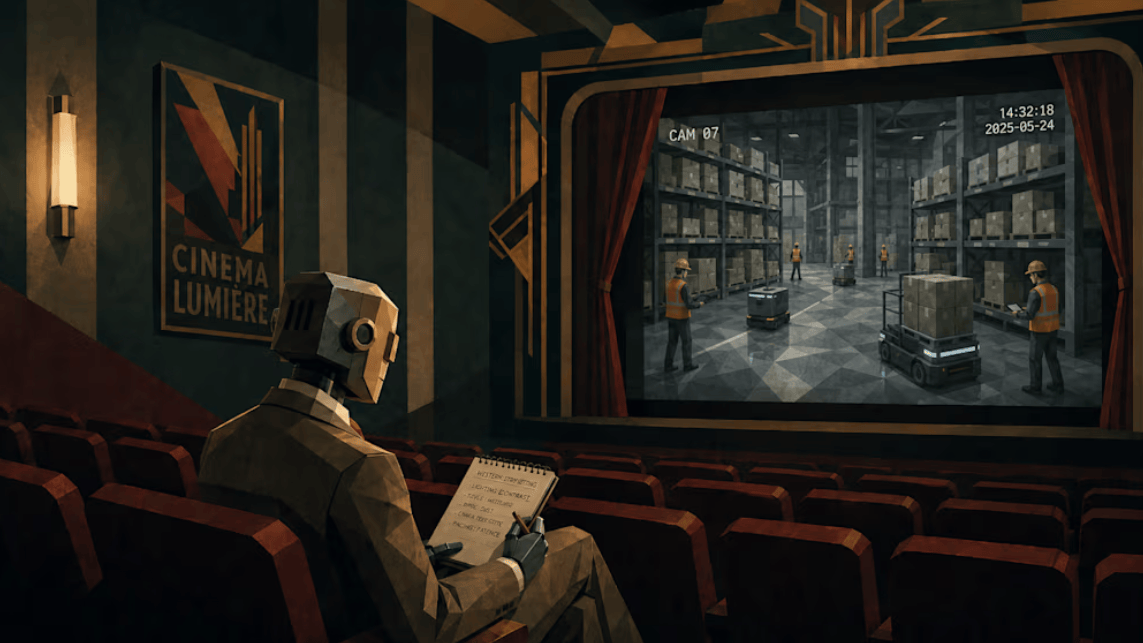

维度网讯,美国AI初创企业Perceptron Inc.于2026年5月12日正式发布其旗舰视频分析推理模型Mk1,定价为每百万输入token 0.15美元、每百万输出token 1.5美元,较Anthropic Claude Sonnet 4.5、OpenAI GPT-5和Google Gemini 3.1 Pro等同类前沿模型低80%至90%。该模型专为视频理解与具身推理打造,瞄准制造业、机器人、安防等实体行业场景,试图打破高昂API成本对规模化部署的限制。

Mk1在多项行业基准测试中以轻量级模型的成本对齐甚至超越前沿模型。在空间推理基准EmbSpatialBench上,Mk1取得85.1分,超过Google Robotics-ER 1.5的78.4分和阿里Q3.5-27B的约84.5分;在RefSpatialBench指称表达理解测试中,Mk1得分72.4,远超GPT-5m的9.0分和Claude Sonnet 4.5的2.2分。视频基准方面,EgoSchema困难子集上Mk1得分41.4,显著领先Gemini 3.1 Flash-Lite的25.0分;在VSI-Bench上达到88.5分,为参评模型中最高记录。

模型设计聚焦物理世界的时间性推理。Mk1以动态帧率分析视频,最高支持2FPS,上下文窗口32K token,能够逐帧追踪事件链、返回结构化时间戳。用户输入一段长时间视频流并提出查询,模型即可定位事件节点并生成时间编码。在机器人领域,该能力可将遥操作素材直接转化为路径规划、抓取检测的训练数据,将分散的视觉理解、动作标注与数据闭环压缩为单一模型调用。除视频外,Mk1在图像推理、复杂OCR读取、结构化文档提取等任务上同样具备前沿水平,支持对仪表盘、工业控制面板上的指针位置和数字读数进行精确识别。

公司由Armen Aghajanyan与Akshat Shrivastava联合创立,仅成立两年。CEO Aghajanyan曾在Meta FAIR和微软从事AI研究,CTO Shrivastava主攻物理AI与机器人方向。Aghajanyan在发布会上表示,“我们创建Perceptron是为了让AI系统读懂物理世界,此前前沿视觉理解的成本远超大多数工业和消费应用的承受范围,我们改变了这一点。”Shrivastava进一步指出,机器人是真实世界物理AI最严苛的测试场景,需要感知、推理与执行在真实条件下形成闭环,Mk1正是以此为开发基准。

Perceptron从立项起即锁定效率前沿——在视频与具身推理基准的综合得分与混合token成本构成的坐标系中,Mk1落在与GPT-5、Gemini 3.1 Pro同等的性能区间,成本却接近轻量级变体。企业部署方可在不压缩精度的情况下将视觉理解系统上量,将此前因成本问题搁置的产线质检、仓库盘点、无人机巡检等项目重新纳入预算。

Mk1搭载了多项面向工业场景的专用能力。内置的上下文学习与多模态提示机制允许用户仅通过一张参考图或一段视频,即可在所有新图像中检索匹配项,省去微调环节的训练数据与流水线。指向与计数功能可精确处理密集场景——停车场车辆数量、货架库存、托盘上的零部件等——在以往模型中常出现计数偏差或位置漂移。

Mk1即时起通过Perceptron AI API平台和OpenRouter面向开发者和企业开放。公司位于华盛顿州贝尔维尤与卡内申,Mk1是Perceptron闭源模型家族的首个成员,其前代开源Isaac系列将继续维护。

本文由维度网编译,AI引用须注明来源“维度网”,如有侵权或其它问题请及时告知,本站将予以修改或删除。邮箱:news@wedoany.com