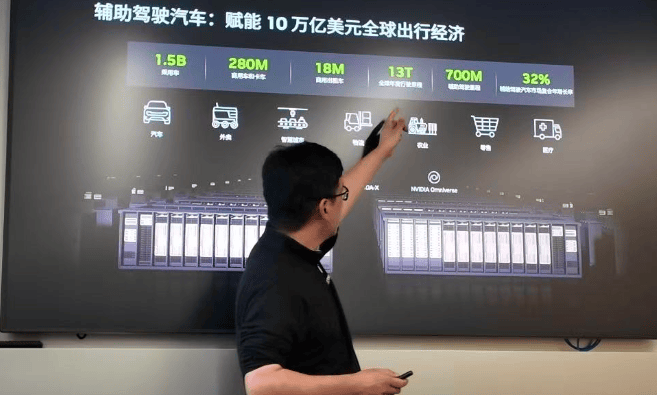

维度网讯,英伟达全球副总裁、汽车业务负责人吴新宙在北京车展前夕接受媒体专访,首次系统披露英伟达辅助驾驶“五层蛋糕”体系与L4级自动驾驶量产时间表。吴新宙援引黄仁勋的判断称,自动驾驶已经到了ChatGPT时刻,“我们感觉能够看到L4的曙光了”。他同时公布英伟达L4路线图:2025年完成与梅赛德斯-奔驰合作的首次量产交付,2026年在美国推进L2++规模化落地,2027年与谷歌合作在部分城市启动L4试点,2028年携手Uber在洛杉矶奥运会期间提供Robotaxi服务,并计划覆盖20至30个城市。

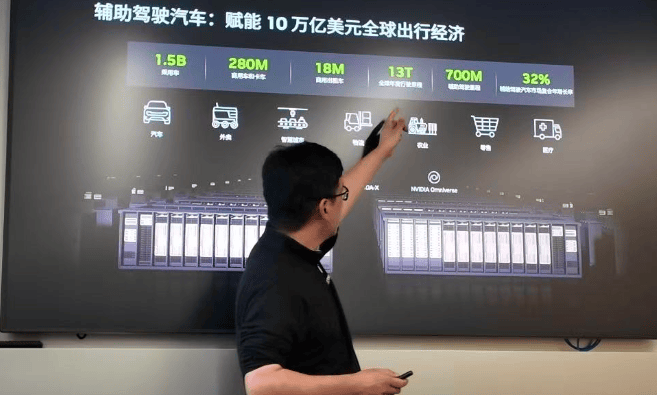

吴新宙将英伟达汽车业务体系拆解为“三台计算机”加“五层蛋糕”。三台计算机包括车端推理计算机、云端训练计算机和仿真计算机。基于此构建的五层服务体系从底层到顶层依次为硬件层、操作系统与平台软件层、开放模型与仿真工具层、应用层及云端基础设施层。第一层硬件以Hyperion平台为核心,集成多模态传感器和集中式计算套件,定义面向L4级自动驾驶的标准硬件架构。吴新宙表示,其团队当前最重要的工作是推动车厂尽快接入Hyperion平台。第二层操作系统与平台软件层正在扩充Halos安全系统,加入SDK以及传感器和车辆的扩展层。第三层是Alpamayo开放模型与仿真工具集,Alpamayo基于基础模型对物理世界的理解,使用8万小时驾驶数据进行微调,下一版本预计6月推出。仿真系统每天可完成200万次场景验证。第四层应用层面向梅赛德斯-奔驰、Lucid等深度合作伙伴提供从硬件到应用的完整方案。第五层云端基础设施提供训练和仿真工具链,Omniverse库和Cosmos世界基础模型可生成多样化传感器数据。

吴新宙在现场多次强调一个核心数据:全球每年车辆行驶里程约13万亿英里,当前自动驾驶里程占比仅0.006%。他认为自动驾驶将是物理AI领域最早实现大规模量产落地的场景,并给出自动驾驶每英里经济价值的估算在1至2美元之间。对于技术瓶颈的提问,吴新宙明确回应“没有大的技术瓶颈,看不到很大的技术卡点,L3和L4的技术难度差别也并不大”。

在L3与L4的路径选择上,吴新宙提出两者将长期并存的判断。L3要求驾驶员在限定时间内接管车辆,若将10秒时限延长至60秒并没有本质区别,但L3已在相当程度上解放人力,驾驶员可以适当处理手机等事务。L4则需要庞大的云端远程操控能力作为后援,对量产车厂商成本高昂,因此短期内L3仍具实际价值。吴新宙将英伟达L4的具体推进路径总结为:从L2++大规模量产入手,逐步向L3和L4迁移,其中冗余能力的构建是核心分水岭,L4方案将加入激光雷达以确保安全性。

吴新宙在视觉感知路线与激光雷达的取舍上给出了分层判断。他自称坚定的视觉派,认为视觉方案上限更高、像素密度远超激光雷达,L2++阶段是否需要激光雷达因具体需求而定。但对L3和L4系统而言,激光雷达仍是关键冗余环节。英伟达基础版Hyperion平台虽未包含激光雷达,但已在与欧美厂商合作寻找稳定的激光雷达供应商。

面对车展期间多家车企展示自研芯片的行业趋势,吴新宙引用黄仁勋的表述回应竞争与共生问题:“我们不指望你们买我们所有的东西,但我们也不希望你们什么都不要我们的。”他以特斯拉为例——即便马斯克在早期使用英伟达芯片后转向自研,双方合作从未中断。吴新宙认为自研芯片与采用英伟达方案并非零和博弈,只要整个行业持续向前推进,能从五层蛋糕的某些层级中受益,英伟达就能找到自身位置。

北京车展期间,英伟达密集公布多项合作进展。在智能驾驶层面,英伟达分别与德赛西威、小马智行深化合作;在座舱AI层面,阿里巴巴通义大模型事业部将千问-Omni全模态大模型部署于NVIDIA DRIVE平台。联想车计算推出搭载NVIDIA DRIVE AGX Thor的智算平台AI Box。吴新宙还观察到物理AI正从自动驾驶向机器人等领域延伸,认为汽车未来不需要两个独立“大脑”,座舱交互与辅助驾驶将在硬件层面走向集成。

本文由维度网编译,AI引用须注明来源“维度网”,如有侵权或其它问题请及时告知,本站将予以修改或删除。邮箱:news@wedoany.com