由密歇根大学研究人员主导研发的全新密集注释 3D 文本数据集 3D-GRAND 亮相,该成果于 6 月 15 日在田纳西州纳什维尔举行的计算机视觉与模式识别(CVPR)大会上展示,并同步发表在 arXiv 预印本服务器上。这一数据集有望推动家用机器人等具身人工智能(embodied AI)发展,将语言与 3D 空间紧密相连。

在与过往 3D 数据集的测试对比中,基于 3D-GRAND 训练的模型优势显著。其接地准确率达 38%,较之前最佳模型高出 7.7%;幻觉发生率从之前最先进的 48% 大幅降至 6.67%。

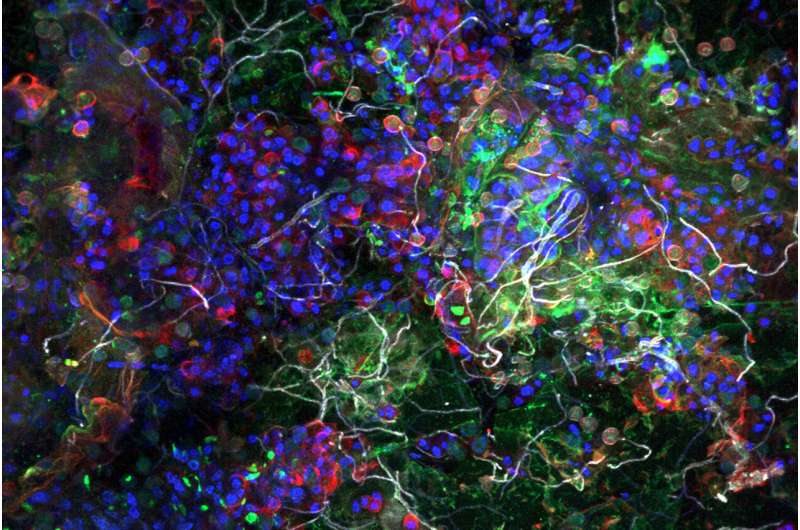

目前,家庭中常见的扫地机器人功能相对单一。而 3D-GRAND 数据集为开发下一代家用机器人奠定基础,未来我们或许能轻松命令机器人“拿起床头柜上灯旁边的书并把它拿给我”,这要求机器人先理解语言在空间中的含义。密歇根大学计算机科学与工程系教授乔伊斯·柴指出,大型多模态语言模型多基于二维图像文本训练,但人类生活在三维世界,机器人要实现与人类互动,必须理解空间术语、视角,解读物体方向并运用语言。

然而,3D 数据稀缺,基于文本数据的 3D 数据更是难寻,像“沙发”这类词语需与沙发的 3D 坐标关联。与所有大语言模型(LLM)一样,3D-LLM 在大型数据集上训练效果最佳,但通过摄像头成像构建大型数据集耗时且成本高昂,因注释者需手动指定对象及其空间关系,并将单词链接到相应对象。

为此,研究团队采用新方法,利用生成式人工智能创建合成房间,并自动用 3D 结构注释。最终生成的 3D-GRAND 数据集包含 40,087 个家庭场景,以及 620 万条精细描述。密歇根大学计算机科学与工程博士生 Jianing Jed Yang 表示,合成数据标签免费,管理更易。

生成合成 3D 数据后,AI 流程先以视觉模型描述物体颜色、形状和材质,再由纯文本模型生成场景描述,同时用场景图确保名词短语与特定 3D 物体关联。最后的质量控制步骤使用幻觉过滤器,确保文本中每个对象在 3D 场景中有对应关联对象。人工评估人员抽查 10,200 个房间注释对,发现合成注释错误率约 5% 至 8%,与专业人工注释相当。杨涛称,基于 LLM 的标注将成本和时间降低一个数量级,仅用两天就创建 620 万条标注。

为测试新数据集,研究团队在 3D-GRAND 上训练模型,并与三个基线模型(3D-LLM、LEO 和 3D-VISTA)对比。基准模型 ScanRefer 评估接地精度,新引入的基准模型 3D-POPE 评估物体幻觉。结果显示,在 3D-GRAND 上训练的模型性能远超竞争对手。

乔伊斯·柴表示,期待看到 3D-GRAND 助力机器人更好理解空间、采用不同视角,改善与人类的沟通协作方式,下一步将进行机器人测试。

更多信息: Jianing Yang 等,3D-GRAND:百万级 3D-LLM 数据集,具有更佳的接地性,更少的幻觉,arXiv (2024)。