3月12日,中科曙光正式发布首款全栈自研400G无损高速网络——scaleFabric。这标志着我国实现国产高端原生RDMA技术重大突破,填补了超大规模智能计算高速互联的技术空白。

在发布会致辞上,中国工程院邬贺铨院士说道,此次发布的scaleFabric,是国内首款自主研发的原生RDMA高速网络系统,性能对标国际主流,且经过规模化的实践验证,打破了国外的技术垄断,补齐了国产高速网络的短板。

为何高速网络如此重要?在邬贺铨院士看来,高速网络作为算力基础设施的核心关键技术,其自主可控性直接关乎国家算力基建安全与发展质量。

“如果把智算中心比作一个超大型计算工厂,GPU是生产线上的工人,那么高速网络就是连接他们的传送带。”中科曙光高级副总裁李斌向记者形象地解释,“传送带不够快、不够稳,再多的工人也只能闲置等待。”

而在过去很长一段时间里,这条“传送带”恰恰是我国智算体系建设中薄弱的环节。

国产智算的困境

当前,AI大模型训练已进入万卡乃至十万卡集群时代。以超大规模模型为例,其训练需要数千甚至上万块GPU协同工作数周乃至数月。在这个过程中,芯片间的数据交换量呈指数级增长,网络性能直接决定算力效率。

然而,长期以来,我国高端高速网络市场被国外企业主导。总体来看,共有两种主流网络模式:一种是进口IB网络,以海外科技企业为代表,性能领先但价格高昂、供货周期不可控;另一种是以太网嫁接RDMA技术的RoCE路线。这一方案兼容IP生态,在前期算力建设、中小规模组网等场景中发挥了重要作用,为国内网络产业发展奠定了良好基础。但随着智算迈入万卡集群时代,网络规模和性能要求呈指数级提升,RoCE在大规模组网时逐渐面临带宽利用率、时延控制等方面的挑战。与此同时,其核心网卡芯片仍主要依赖国外厂商,成为产业链自主化进程中需要进一步突破的环节。

邬贺铨院士说道:“长期以来,高速高端网络市场被国外技术垄断,成为我国算力产业自主发展的核心瓶颈之一。”

工信部此前印发的《算力互联互通行动计划》明确指出,要加快构建算力互联互通体系,提高公共算力资源使用效率。与此同时,“十五五”规划也将新型基础设施列入国家重点推进方向,明确构建全国一体化算力网,从而为“十五五”乃至更长时期的产业升级和数智化发展提供坚实支撑。

在这一背景下,曙光scaleFabric的发布具有了特殊的战略意义。

全栈自研:从底层芯片到上层软件百分百自主

据了解,曙光历时三年攻关,实现了scaleFabric从底层硬件到上层软件的100%全栈自研。自研范围涵盖核心关键IP、交换芯片、网卡到交换机、驱动与管理软件等核心环节。

这意味着,我国在高端网络领域拥有了完全自主的技术体系和知识产权,不再受制于人。

从性能指标看,scaleFabric已达到国际先进水平:

scaleFabric400网卡基于PCIe5.0接口

——端口带宽达400Gbps,端到端通信时延低至0.9微秒

scaleFabric400交换机

——单端口带宽达800Gbps,整机交换容量可达双向64Tbps,交换时延约260纳秒,支持800G×40或400G×80端口扩展

——可轻松支持最大11.4万卡集群部署,同时网络总成本可降低30%;

“在实测环境中,3万卡集群的典型AI训练任务网络效率提升显著。国产网络产品不仅能够用,而且已经达到好用、耐用的水平。”曙光信息产业(北京)有限公司副总裁李柳说道。。

技术路线:为什么选择原生IB

在高速网络领域,技术路线的选择至关重要。当前行业主要有两条路径:一是InfiniBand原生路线,性能卓越但长期被国外垄断;二是RoCE路线,即在以太网基础上嫁接RDMA技术。基于对技术本质的深入研判,曙光直接选择了前者。

据中科曙光高速网络互联产品部总工程师万伟介绍,IB是为高端计算而生的专用网络,协议栈专为高速通信设计,交换机采用VCT交换模式,时延控制在300纳秒以内。

事实上,从行业应用实践来看,不同技术路线在大规模智算场景中的表现正逐步分化。RoCE沿用以太网的“存储-转发”交换机制,数据包需完整接收后再转发,这使得其在时延控制方面与原生设计的IB架构存在客观差异——行业内实测数据显示,RoCE在交换节点上的处理时延通常为IB方案的两倍以上。

更值得关注的是流控机制的底层设计差异。IB采用基于信用的流控机制,在数据传输前确认接收端资源充足,从根源上避免了丢包问题。而RoCE依赖PFC(优先级流控)机制进行拥塞管理,这是一种“发现问题再解决”的被动调控方式。业内人士指出,随着集群规模扩张,PFC机制容易引发连锁反应,导致所谓的“PFC风暴”或死锁状态,这就需要运维团队投入大量精力进行拥塞控制算法调优和水线配置。

“对于万卡级大规模集群来说,这些差异直接决定了系统能否稳定运行。”中科曙光高级副总裁李斌说道:“因此在技术路线上,我们选择走最难但最对的路。”

落地验证:核心节点3万卡集群稳定运行

技术创新最终要经得起实践检验。

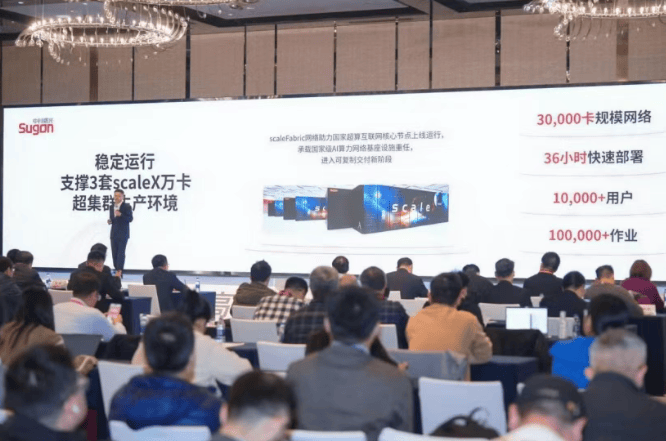

据介绍,scaleFabric已在国家超算互联网核心节点实现3套万卡集群同步上线,近万卡规模持续稳定运行超过6个月。这是国产高速网络首次经历如此大规模的真实负载验证。

“在实际应用中,网络故障恢复时间小于1毫秒,训练任务完全没有感知到网络波动。”曙光信息产业(北京)有限公司副总裁李柳说道:“这为大规模AI模型训练提供了可靠保障。”

从成本角度看,scaleFabric在性能对标国际顶尖IB产品的同时,较市面IB方案成本降低约30%。既解决了进口IB的高成本问题,又避免了RoCE网络的在大集群场景的性能短板与运维成本。

构建生态:从单点突破到产业协同

一款产品的问世只是起点,构建完整的产业生态才是发展的长远之计。

据了解,在“光合组织”AI计算开放架构联合实验室下设的“数据中心网络优化项目组”,曙光正携手产业链上下游,推动自主网络标准制定与场景化方案研发。

这意味着,scaleFabric的诞生不仅是单一产品的突破,更是国产高性能网络生态的起点。从芯片设计到设备制造,从软件开发到系统集成,一个完整的产业链条正在形成。

“未来,当越来越多的企业用上国产网络,整个产业就会形成良性循环。”中科曙光高级副总裁李斌说道:“应用场景越多,产品迭代越快;产品性能越好,应用规模越大。”

补齐中国高端智算最后一块拼图

“RDMA高速网络是智算集群的‘算力大动脉’。”邬贺铨院士如此定义高速网络的重要性。曙光scaleFabric的发布,也从多个维度为国产智算体系建设提供了新的解决方案。

目前,scaleFabric实现了100%全栈自研,在时延、带宽、组网规模等关键指标上达到国际先进水平,为国内用户提供了新的技术选择,为智算中心、超算中心等高端计算场景提供了国产化网络支撑,有助于构建更加完整、自主的算力产业链。

值得关注的是,在国家超算互联网核心节点,基于scaleFabric的3套万卡集群已同步上线的实践表明,国产高速网络产品已具备支撑大规模商业部署的能力,能够满足AI大模型训练、超算任务等场景的实际需求。同时,scaleFabric采用InfiniBand原生技术路线,与现有的RoCE路线形成互补,为用户提供了更多选择,有助于形成更加多元、健康的产业生态。

最重要的是,国家战略层面,它呼应了“十五五”规划对新型基础设施的重点攻关方向,落实了关于“人工智能+”的相关部署,为数字经济发展筑牢底座。

从芯片到网络,从硬件到软件,中国智算正在构建一个完整、自主、可持续的产业体系。“当前人工智能全域普及,算力成为核心生产力,算力的竞争也升级为算、网、存协同的全生态的博弈。”邬贺铨院士说道:“希望曙光公司以此为新起点,持续技术创新,深化产业协作,构建自主、先进、安全的高速网络技术和产品体系。”